VirtIO-GPU(2D)& VirtIO-Input in semu

VirtIO-GPU(2D)& VirtIO-Input in semu

專題,預期產出是

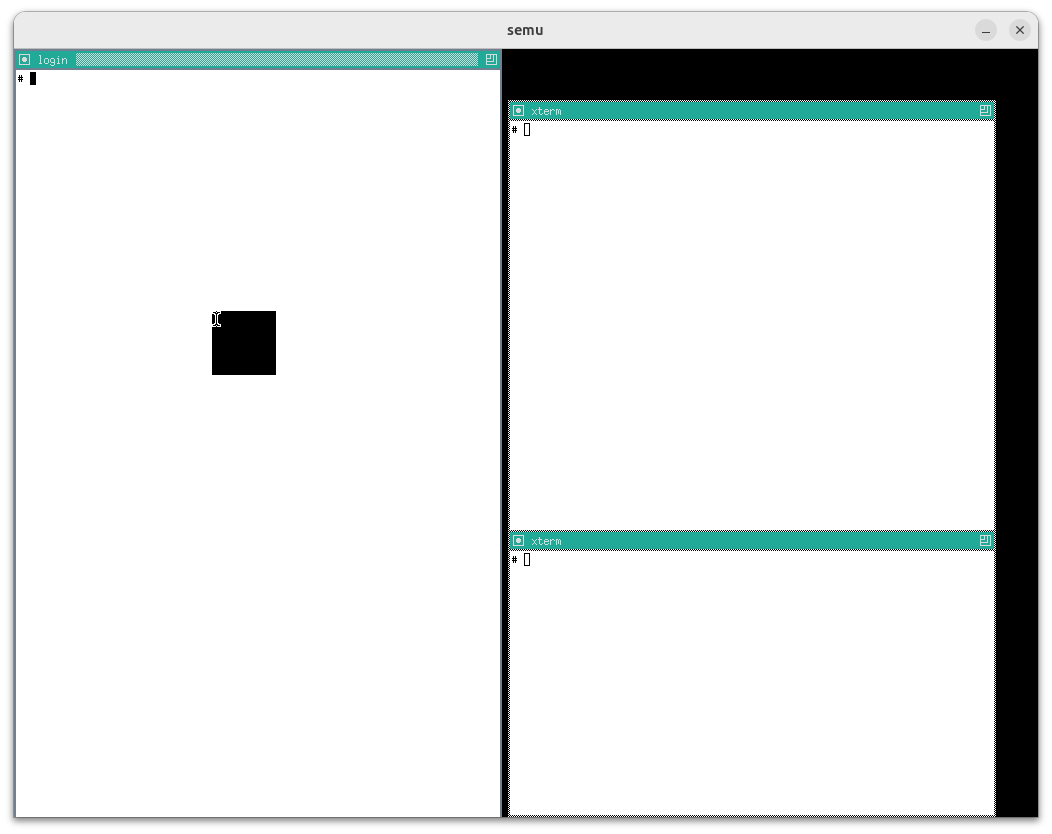

- 最低限度在 semu 支援 virtio 2D(with SDL)

- 支援 virtio-gpu 及 virtio-input

- 實作 host-GL accelerated path,讓 virtio-gpu 得以 passthrough

目前已將 2D 的部分閱讀與整理完畢,也剛把 commit 整理好。 確認重新編譯沒有問題後,就會 rebase 並送出 PR

材料部分,目前已初步讀完 spec 中 virtqueue(ch1 & 2)、PCI(4.1)、GPU(5.7)與 Input(5.8)的部分。 另外也讀了一些 graphic stack 相關資料,因此整理了一些筆記

- Red Hat Virtio 介紹文的翻譯 & 筆記

- Virtual I/O Device (VIRTIO) Version 1.3 翻譯 & 筆記

- The Linux graphics stack in a nutshell 翻譯 & 筆記

另外還有一些仍在進行中的筆記,主要集中在 DRM/KMS。 底下這篇則是針對目前 semu 中 vgpu 2D 部分實作的筆記,3D 部分尚未開始

後面有紀錄了一些遇到的問題,和做 trace code 的過程,但是我仍然不是很熟悉 Mesa、X11 與 DRM/KMS,如果有寫錯的部分,麻煩再告知我,謝謝

目前整理出來的 TODO

把各節零星提到的限制集中起來,大概有五項:

- eventq buffer 不足時,semu 目前直接丟掉這批 host 事件。

virtio-input.c裡已經留了TODO: Consider buffering events instead of dropping them,但目前還沒有額外的 host 端暫存區,也沒有後續重送機制 - statusq 還沒有裝置端消費路徑。 guest 可以把 statusq 配好,也能送出 LED 類型的狀態事件,但 semu 目前沒有對應

virtio_input_handle_sts()或virtio_input_hid_handle_status()這樣的邏輯 window-events.c裡的sdl_scancode_to_linux_key()還是線性搜尋,這是前面 input 事件章節提過的另一個已知 TODO。 功能上不會錯,但在設計上還算明顯的待清理項.ci/test-vinput.sh目前只驗證裝置節點與 guest 枚舉結果,還沒有覆蓋 host 事件注入、eventq 掉事件行為,或 statusq / LED 回饋這幾條路徑display_info的架構問題,詳見問題 5 一節

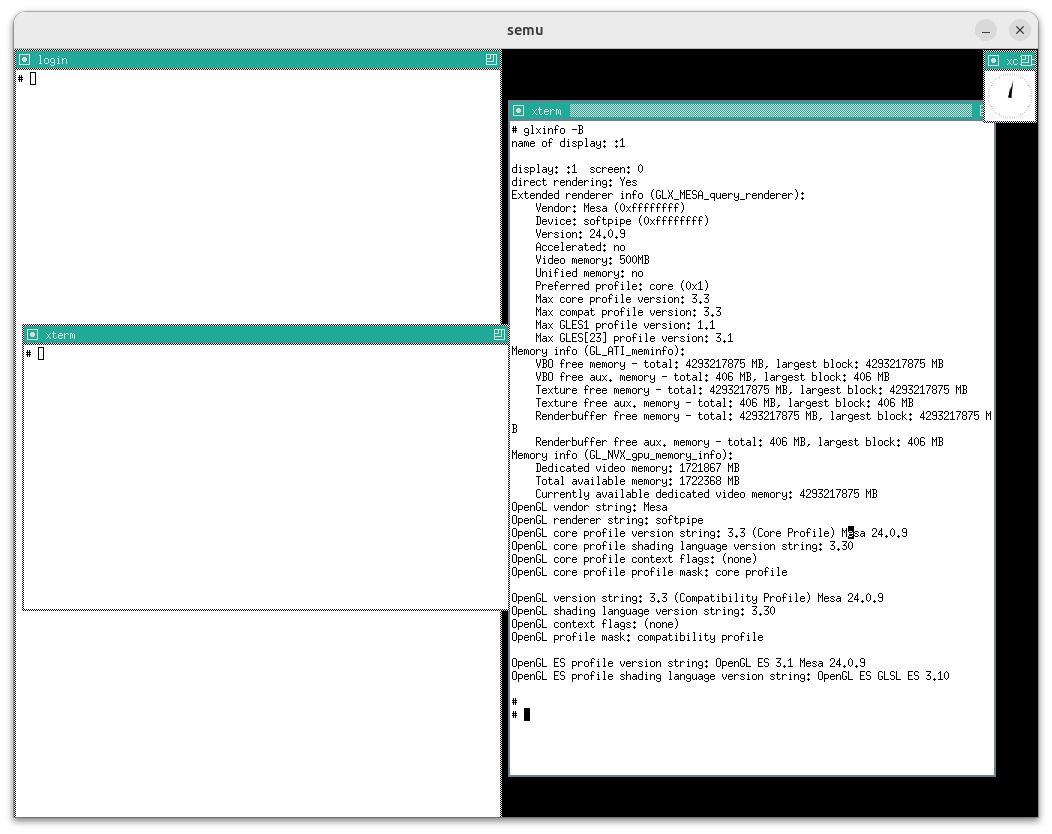

有關 VirGL

以下片段翻譯自 Do Nvidia GPUs require Mesa? (re: what is Mesa vs proprietary drivers?):

在 Linux 當中,所有硬體的驅動程式都會以某種形式被包含在核心裡面,這當然也包含了 GPU 驅動。 每一張 GPU 都需要一個核心驅動(或說 kernel module 模組)才能運作

但核心驅動只負責最低層級的硬體操作。 像 OpenGL、Vulkan、OpenCL 這些 API 的實作太龐大,無法放進核心驅動中,因此會放在使用者空間,透過系統呼叫與核心互動

要使用任何圖形 API,你都需要有對應的使用者空間函式庫。 AMD 與 NVIDIA 的專有驅動都有提供每一個 API 的封閉原始碼版本,而 Mesa 則是試圖提供這些 API 的開源替代實作

專有驅動通常也會附帶它們自己專有的核心驅動/模組,用來和它們的使用者空間函式庫溝通。 但對於 AMD 的新 GPU 來說,情況稍有不同:他們的專有與開源驅動會共用同一個核心模組。 換句話說,若你使用的是 Radeon R9 285(GCN 3) 之後的 GPU,你可以在相同的 AMDGPU 核心驅動下,選擇搭配 Mesa(開源函式庫)或 AMD 專有函式庫

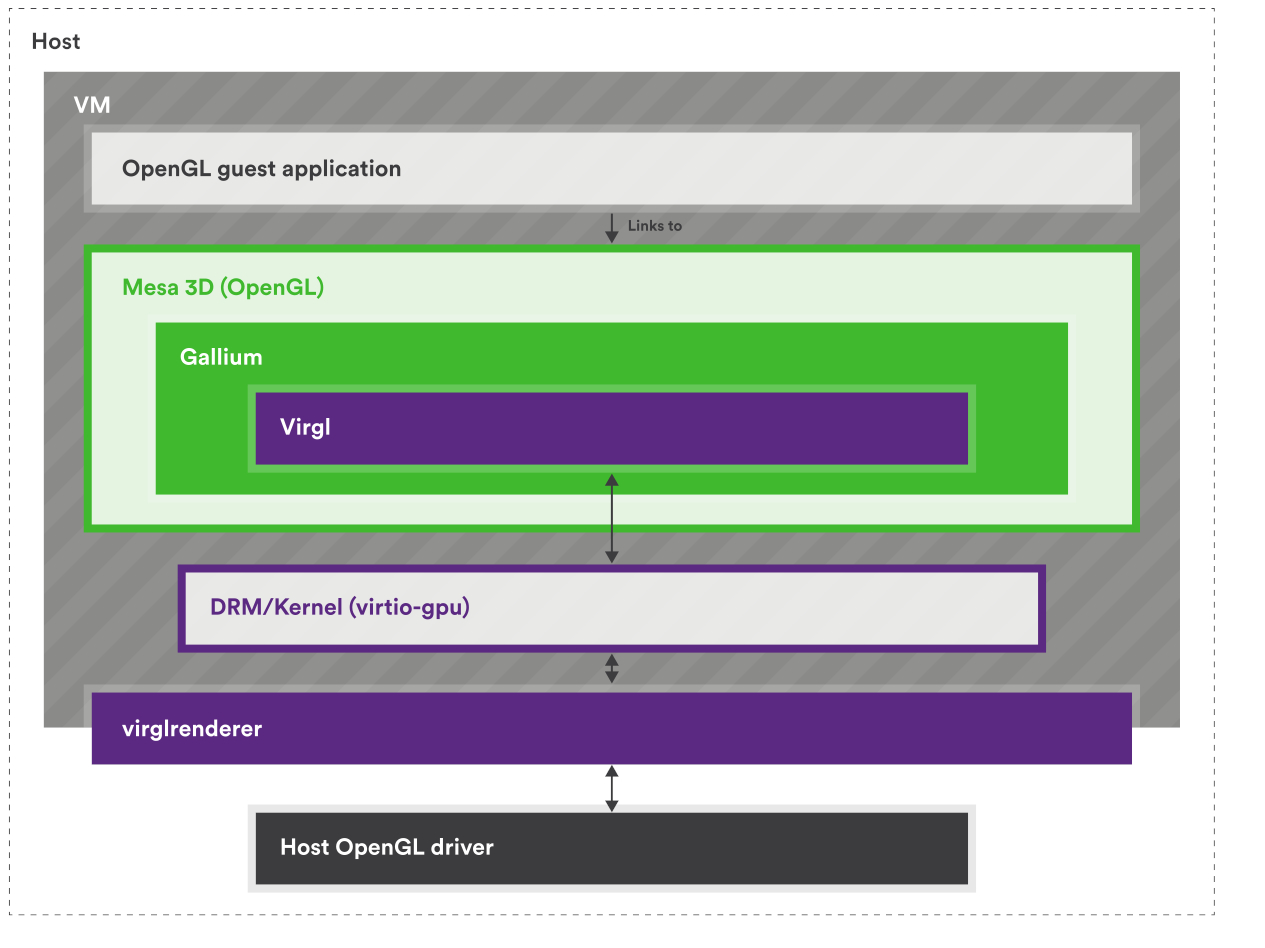

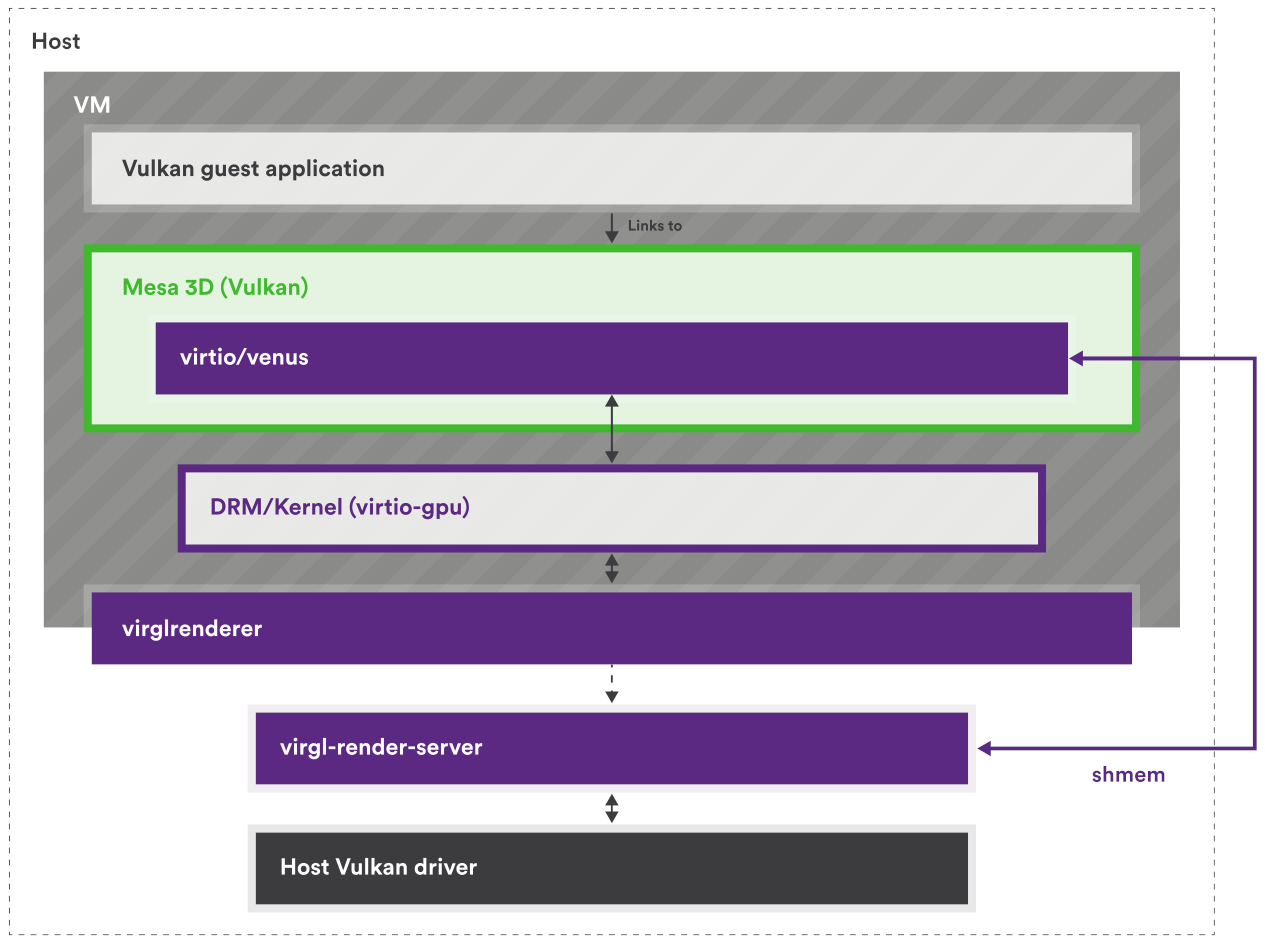

再來以 Collabora 的這兩張圖來說,VirGL 是適用於 virtio-gpu 的 OpenGL 驅動,Venus 是 virtio-gpu 的 Vulkan 驅動,這兩者都實作在 Mesa 中:

但因為 virtio-gpu 只定義了要有哪些行為,例如建立 context、建立 BLOB 資源或提交 3D 指令之類的,所以實際填入 virtqueue 的資料內容(payload)是由實作方決定的

具體來說,要填入的是能讓 host 端轉譯器看懂的資料內容,因此格式會由各實作自己的協定來定義。 現在主流的實作是 Virgl 與 Venus(近年有新的叫 vDRM),它們在 host 端配合的轉譯器是 virglrenderer,用來解碼 VirGL/Venus 與 vDRM 的命令,再把這些命令轉成 host 端的 OpenGL/Vulkan 呼叫

所以 virtio-gpu 決定封包的格式,而實作本身決定封包內容要怎麼解讀

實作用的協定本身不一定有正式規格(神奇),VirGL 就沒有,所以要直接看實作(VirGL、virglrenderer),但 Venus 有(venus-protocol)

Big Picture

這篇文章會整理 semu 裡的 virtio-gpu、virtio-input,以及 SDL 視窗後端之間怎麼協作,把 semu 自己的裝置模型、資料結構、控制流程與近期架構調整說清楚,這主要可以分成五個部分:

main.c負責虛擬機器核心與裝置接線:- 把 MMIO 位址區間映射到各個裝置

- 初始化 scanout、視窗後端與輸入裝置

- 建立虛擬機器執行緒與 SDL 主執行緒的分工

- 在執行迴圈裡同步各裝置的中斷狀態

virtio-gpu.c負責 VirtIO-GPU 裝置模型的核心邏輯:- 處理 MMIO 暫存器讀寫

- 維護 controlq / cursorq 的 virtqueue 狀態

- 解析 guest 提供的 descriptor 鏈

- 回覆 EDID / display info

- 把各種 GPU 命令分派給後端處理函式

virtio-gpu-sw.c負責 2D 軟體後端的命令處理函式:- 建立與銷毀

vgpu_resource_2d - 處理 attach backing / detach backing

- 執行

TRANSFER_TO_HOST_2D,把 guest backing 複製到 host image buffer - 處理

SET_SCANOUT、RESOURCE_FLUSH與鼠標命令

- 建立與銷毀

virtio-input.c負責 VirtIO-Input 裝置模型:- 處理鍵盤 / 滑鼠兩個 MMIO 裝置的暫存器讀寫

- 維護 eventq / statusq 的 virtqueue 狀態

- 回覆對裝置組態空間的查詢,例如裝置名稱、事件位圖與 ABS 資訊

- 把 host 端輸入事件寫進 guest 提供的事件緩衝區,並更新 used ring / 中斷

window-sw.c與window-events.c負責 SDL 視窗與 host 端輸入事件:- 把 guest framebuffer 與鼠標影像轉成 SDL 紋理

- 維護每個 scanout 的算繪端快照

- 在主執行緒處理 SDL 視窗事件的迴圈

- 把 SDL 鍵盤滑鼠事件送進 guest 的 virtio-input 的事件佇列

從執行方向來看,這套實作主要有兩條路徑:一條是 guest 把畫面送到 host 視窗,另一條是 host 把輸入事件送進 guest:

- 畫面輸出路徑:

- guest 端的 DRM / virtio-gpu 驅動建立 2D resource

- guest 替這個 2D resource attach backing

- guest 送出

TRANSFER_TO_HOST_2D,semu 在virtio-gpu-sw.c中把 guest backing 的像素資料複製到 host 端的vgpu_resource_2d.image - guest 再送出

RESOURCE_FLUSH window-sw.c把目前的 scanout 快照轉成 SDL 紋理,並畫到視窗上

- 輸入事件送入 guest 的路徑:

- host 端產生 SDL 鍵盤或滑鼠事件

window-events.c把它轉成 Linux input code 與對應的事件組合virtio_input_update_key()、virtio_input_update_mouse_button_state()或virtio_input_update_cursor()接手整理事件virtio-input.c把事件寫進 guest 提供的 eventq 緩衝區- 裝置更新 used ring,並在需要時設定中斷

雖然這兩條路徑最後都會碰到 SDL 視窗與 main.c 的虛擬機器狀態,但中間走的是兩套不同的裝置協定。 可以拆成四點來看:

- 畫面輸出路徑

- guest 端的畫面相關命令會透過 virtio-gpu 的 controlq 與 cursorq 送進 semu

- guest 送來的是

RESOURCE_CREATE_2D、TRANSFER_TO_HOST_2D、RESOURCE_FLUSH、UPDATE_CURSOR這類 GPU 命令 - semu 由

emu.vgpu保存裝置狀態、queue 的位置與中斷狀態 - 真正的處理由

virtio-gpu.c與virtio-gpu-sw.c分工完成

- 輸入事件路徑

- 不只有一個 virtio-input 裝置,而是有兩個獨立的裝置實例

emu.vkeyboard負責鍵盤,emu.vmouse負責滑鼠

- guest 不會透過 virtio-gpu 接收鍵盤滑鼠事件

- 鍵盤與滑鼠各自擁有自己的 MMIO 暫存器、eventq / statusq、裝置組態空間與

InterruptStatus

- 不只有一個 virtio-input 裝置,而是有兩個獨立的裝置實例

- 兩條路徑共享的部分

- 它們不共用 descriptor 格式、queue 的處理邏輯或命令集合

- 它們共享的是比較外層的基礎設施,例如

main.c的 MMIO dispatch、PLIC 中斷的更新、guest RAM 的指標與 SDL 事件迴圈

g_window的角色g_window不是 VirtIO 協定的一部分- 它是 semu 自己定義的 host 端後端 API

virtio-gpu-sw.c透過g_window.window_flush()、g_window.cursor_update()等函式把畫面資料交給 SDLmain()則透過g_window.window_init()、g_window.window_main_loop()啟動與維護視窗系統

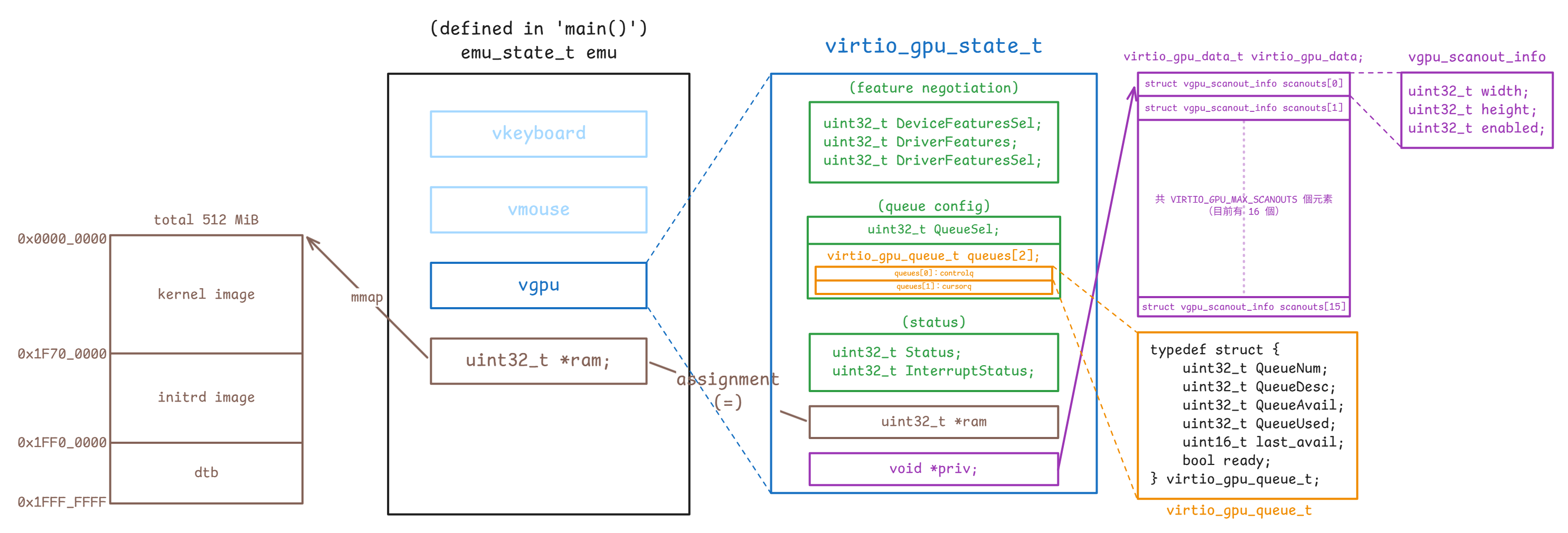

直接對照 main.c 裡的虛擬機器狀態,會更清楚它的分工:

typedef struct {

/* ... */

#if SEMU_HAS(VIRTIOGPU)

virtio_gpu_state_t vgpu;

#endif

#if SEMU_HAS(VIRTIOINPUT)

virtio_input_state_t vkeyboard;

virtio_input_state_t vmouse;

#endif

/* ... */

} emu_state_t;這裡可以把它理解成三個平行的裝置實例:

emu.vgpu:一個 virtio-gpu 裝置的實例,負責 guest 的顯示輸出emu.vkeyboard:一個 virtio-input 鍵盤裝置的實例emu.vmouse:一個 virtio-input 滑鼠裝置的實例

它們都掛在同一個 emu_state_t 下面,但各自維護自己的 queue、status 與中斷狀態。 之後 g_window 這層 semu 內部後端抽象介面會再把這些裝置接到 host 視窗系統上

資料結構

Virtqueue 相關

semu 中使用的是 split virtqueue,其中只有 descriptor table 有特別寫結構體定義出來:

PACKED(struct virtq_desc {

uint64_t addr;

uint32_t len;

uint16_t flags;

uint16_t next;

});而在規格中,對於 avail ring 與 used ring 的佈局示例如下:

struct virtq_avail {

#define VIRTQ_AVAIL_F_NO_INTERRUPT 1

le16 flags;

le16 idx; /* number of available ring entries posted by the driver */

le16 ring[ /* Queue Size */ ];

le16 used_event; /* only present when VIRTIO_F_EVENT_IDX is negotiated */

};

struct virtq_used {

#define VIRTQ_USED_F_NO_NOTIFY 1

le16 flags;

le16 idx; /* number of used entries completed by the device */

struct virtq_used_elem ring[ /* Queue Size */];

le16 avail_event; /* only present when VIRTIO_F_EVENT_IDX is negotiated */

};

/* le32 is used here for padding. */

struct virtq_used_elem {

/* head descriptor index of the used chain */

le32 id;

/* bytes actually written by the device to writable buffers */

le32 len;

};但在 semu 中,avail ring 與 used ring 都是透過直接操作記憶體(vinput->ram)來讀取的,相關結構如下(以 virtio gpu 為例):

typedef struct {

uint32_t QueueNum; // Queue size

uint32_t QueueDesc; // Descriptor table base index

uint32_t QueueAvail; // Available ring base index

uint32_t QueueUsed; // Used ring base index

uint16_t last_avail; // Number of buffers already consumed by the device

bool ready; // Whether the queue is ready

} virtio_gpu_queue_t;

typedef struct {

/* feature negotiation */

uint32_t DeviceFeaturesSel;

uint32_t DriverFeatures;

uint32_t DriverFeaturesSel;

/* queue config */

uint32_t QueueSel;

virtio_gpu_queue_t queues[2];

/* status */

uint32_t Status;

uint32_t InterruptStatus;

/* supplied by environment */

uint32_t *ram;

/* implementation-specific */

void *priv;

} virtio_gpu_state_t;virtio_gpu_state_t 中的 queues 是一個 virtqueue 的陣列,有兩個元素,代表 virtio-gpu 使用了兩個 virtqueue,在 spec 中分別名為 controlq 與 cursorq:

- controlq:用於傳送控制命令的佇列

- cursorq:用於傳送鼠標更新的佇列

virtio_gpu_queue_t 內的元素用來幫助讀取 virtqueue 的內容,QueueDesc、QueueAvail、QueueUsed 的值代表的是索引,會搭配 virtio_xxx_state_t 結構體內的 ram 成員使用,其中 ram 與 emu->ram 指向相同的記憶體區塊(main.c 裡用 mmap() 建出的那塊 guest RAM),這部分後面會再詳細提到

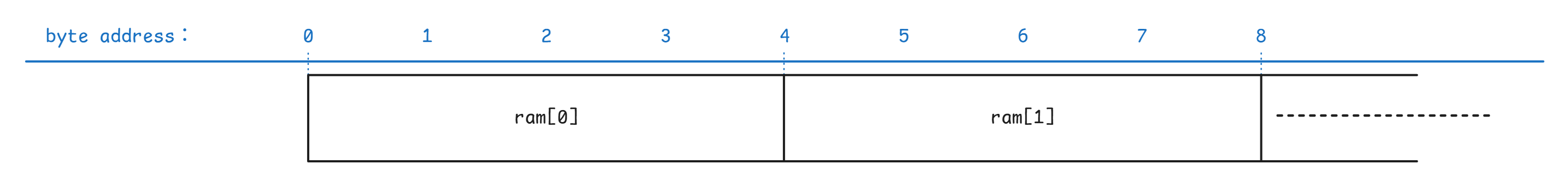

由於 avail ring 與 used ring 中的 flags 與 idx 欄位都是 le16,而 ram 是 uint32_t*,因此以 avail ring 為例,其在 ram 中的佈局看起來會類似下面這樣:

┌─────────────────────────────────┬──────────────────────────┐

│ ram[queue->QueueAvail] │ flags (low) | idx (high) │ ← Header

├─────────────────────────────────┼──────────────────────────┤

│ ram[queue->QueueAvail + 1] │ ring[0] | ring[1] │ ← Entries 0 & 1

│ ram[queue->QueueAvail + 2] │ ring[2] | ring[3] │ ← Entries 2 & 3

│ ram[queue->QueueAvail + 3] │ ring[4] | ring[5] │ ← Entries 4 & 5

└─────────────────────────────────┴──────────────────────────┘其中 QueueAvail 等值在對應的 virtio_xxx_reg_write 中設定:

static inline uint32_t vinput_preprocess(virtio_input_state_t *vinput,

uint32_t addr)

{

// 1. Check whether the address is within RAM

if (addr >= RAM_SIZE)

return virtio_input_set_fail(vinput), 0;

// 2. Check whether the address is 4-byte aligned

if (addr & 0b11) // Check the lowest 2 bits

return virtio_input_set_fail(vinput), 0;

// 3. Convert the byte address to a uint32_t index

return addr >> 2; // Divide by 4

}

...

static bool virtio_input_reg_write(virtio_input_state_t *vinput,

uint32_t addr,

uint32_t value)

{

...

case _(QueueDriverLow):

VINPUT_QUEUE.QueueAvail = vinput_preprocess(vinput, value);

return true;

...

}其中 vgpu_preprocess() 會先檢查 guest 給的位址是否落在 RAM 範圍內,而且必須是 4-byte 對齊,這主要是因為 emu->ram 是 word array,但 guest 給的 QueueDesc、QueueAvail、QueueUsed 都是 byte address,要 >> 2 才能當 index 用

舉例來說,假設記憶體實際長這樣:

此時 Guest 說 QueueDesc = 4,意思是「queue 在 byte 4 的位置」。 但如果我們直接寫 ram[4],C 語言會跳到第 4 個 uint32_t,也就是 byte 16,跳過頭了,所以要做 4 >> 2 = 1,用 ram[1] 才對得上 byte 4

| guest 說的 byte address | >> 2 後 | ram[] index |

|---|---|---|

| 0 | 0 | ram[0] |

| 4 | 1 | ram[1] |

| 8 | 2 | ram[2] |

| 12 | 3 | ram[3] |

位址的檢查通過後,vgpu_preprocess() 會把這個 byte address 轉成對應的 word index。 因此後面 QueueDesc、QueueAvail、QueueUsed 存下來的都不是 host pointer,而是 semu 之後拿來直接索引 ram[] 的位置:

static inline uint32_t vgpu_preprocess(virtio_gpu_state_t *vgpu, uint32_t addr)

{

if ((addr >= RAM_SIZE) || (addr & 0b11))

return virtio_gpu_set_fail(vgpu), 0;

return addr >> 2;

}因此如果 guest 寫入的地址為 0x00100000,則 QueueAvail 會變成 0x00040000。 也因為 vinput->ram 的型態是 uint32_t *,所以之後存取這段記憶體時會用 ram[0x00100000 >> 2],而不是 ram[0x00100000],這也是為什麼這裡說 QueueAvail 保存的是索引:

字節視圖 (uint8_t*): Word 視圖 (uint32_t*):

┌────┬────┬────┬────┐ ┌──────────────┐

│ 0 │ 1 │ 2 │ 3 │ → │ ram[0] │

├────┼────┼────┼────┤ ├──────────────┤

│ 4 │ 5 │ 6 │ 7 │ → │ ram[1] │

├────┼────┼────┼────┤ ├──────────────┤

│ 8 │ 9 │ 10 │ 11 │ → │ ram[2] │

└────┴────┴────┴────┘ └──────────────┘

字節地址 / 4 = uint32_t 索引讓我們以 virtio_input_desc_handler 為例子來看一些使用範例:

讀取 avail 與 used ring 的

idx欄位uint32_t *ram = vinput->ram; uint16_t new_avail = ram[queue->QueueAvail] >> 16; /* virtq_avail.idx (le16) */ uint16_t new_used = ram[queue->QueueUsed] >> 16; /* virtq_used.idx (le16) */讀取 avail ring 內的第

buffer_idx個元素uint16_t queue_idx = queue->last_avail % queue->QueueNum; uint16_t buffer_idx = ram[queue->QueueAvail + 1 + queue_idx / 2] >> (16 * (queue_idx % 2));這邊

last_avail代表已處理過的 buffer 數量,由於 avail ring 是環形的,所以取模以得到下一個目標 buffer 的索引接下來的

queue->QueueAvail + 1代表 avail ring 內ring的起始位址,+1是為了跳過 header。queue_idx / 2用來找到目標 buffer 在ram的哪個元素內,見上方 avail ring 在ram中的示意圖。 最後用16 * (queue_idx % 2)來找到對應的元素,一個ram的元素中有兩個ring的元素因此整個

buffer_idx的計算其實是在讀取ring[queue_idx]的值,而該值代表的是目標 descriptor 的索引,所以變數名稱才會是buffer_idx讀取 Descriptor

uint32_t *desc; desc = &vinput->ram[queue->QueueDesc + buffer_idx * 4]; vq_desc.addr = desc[0]; // Physical address of the buffer uint32_t addr_high = desc[1]; // Only 32-bit addressing is supported, so this must be 0 vq_desc.len = desc[2]; // Buffer length vq_desc.flags = desc[3] & 0xFFFF; // Flags*4是因為每個 descriptor 佔 4 個uint32_t,而算flags時取& 0xFFFF是因為 flags 在desc[3]的低 16 位寫入事件到 Guest Buffer

ev = (struct virtio_input_event *)((uintptr_t)vinput->ram + vq_desc.addr); ev->type = input_ev[i].type; ev->code = input_ev[i].code; ev->value = input_ev[i].value;注意這邊

vinput->ram是 host virtual address,其意義是 guest memory 在 semu 中的起始位址(用mmap()建出的一塊記憶體),而vq_desc.addr是 guest physical address,因此相加就可以得到目標virtio_input_event(descriptor 指向的 buffer)的 host virtual address,後續便可以直接操作該 buffer更新 used ring

uint32_t vq_used_addr = queue->QueueUsed + 1 + (new_used % queue->QueueNum) * 2; ram[vq_used_addr] = buffer_idx; ram[vq_used_addr + 1] = sizeof(struct virtio_input_event);與上方一樣,

new_used % queue->QueueNum是在計算目標 used ring entry 的索引,*2是因為每個 used ring entry 佔 2 個uint32_t(id+len)。 接著就依序填入目標 used ring entry 的id與len欄位

總而言之,virtqueue 操作的流程大致如下:

Linux 分配 virtqueue 記憶體

vring_create_virtqueue()- 在 guest RAM 中分配 descriptor table, avail ring, used ring

Linux 寫入 MMIO registers(通過

writel),見vm_setup_vq:writel(addr_low, base + 0x080):QUEUE_DESC_LOWwritel(addr_high, base + 0x084):QUEUE_DESC_HIGHwritel(addr_low, base + 0x090):QUEUE_AVAIL_LOWwritel(addr_high, base + 0x094):QUEUE_AVAIL_HIGHwritel(addr_low, base + 0x0a0):QUEUE_USED_LOWwritel(addr_high, base + 0x0a4):QUEUE_USED_HIGHwritel(1, base + 0x044):QUEUE_READY

SEMU 接收 MMIO write(

virtio_xxx_reg_write)case QueueDescLow:儲存 descriptor table 位址case QueueDriverLow:儲存 available ring 位址case QueueDeviceLow:儲存 used ring 位址case QueueReady:標記 queue 就緒

之後 SEMU 就可以通過這些位址訪問 guest 的 virtqueue 了

ram[queue->QueueDesc + offset]ram[queue->QueueAvail + offset]ram[queue->QueueUsed + offset]

virtio_gpu_state_t 與 virtio_gpu_queue_t

vgpu_resource_2d 不在此圖內,因為它不直接與 emu_state_t 有關)對應的結構定義如下(device.h):

typedef struct {

uint32_t QueueNum;

uint32_t QueueDesc;

uint32_t QueueAvail;

uint32_t QueueUsed;

uint16_t last_avail;

bool ready;

} virtio_gpu_queue_t;

typedef struct {

uint32_t DeviceFeaturesSel;

uint32_t DriverFeatures;

uint32_t DriverFeaturesSel;

uint32_t QueueSel;

virtio_gpu_queue_t queues[2];

uint32_t Status;

uint32_t InterruptStatus;

uint32_t *ram;

void *priv;

} virtio_gpu_state_t;virtio_gpu_state_t 是 semu 用來保存 virtio-gpu MMIO 暫存器狀態的核心結構。 具體來說:

DeviceFeaturesSel、DriverFeatures、DriverFeaturesSel:對應 feature negotiation 相關的暫存器QueueSel:表示 guest 目前正在設定哪一條 queuequeues[2]:保存controlq與cursorq各自的 queue layout 與執行進度queues[0]對應到controlqqueues[1]對應到cursorq

Status、InterruptStatus:保存裝置狀態與待處理的中斷ram:指向 guest RAM,讓裝置可以直接讀寫 descriptor table 與 avail/used ringpriv:指向virtio_gpu_data_t,保存 scanout 相關的 host 端資訊

virtio_gpu_queue_t 則是 semu 追蹤單一 virtqueue 所需的狀態。 具體來說:

QueueNum:這條 queue 的 ring 大小QueueDesc:descriptor table 在 guest RAM 裡的起點QueueAvail:avail ring 在 guest RAM 裡的起點QueueUsed:used ring 在 guest RAM 裡的起點last_avail:裝置上次已經處理到哪個 avail indexready:guest 是否已完成這條 queue 的配置,並把它設成可用

目前的設計內沒有另外維護一份 host 端的 queue 物件,semu 現在直接把 QueueDesc / QueueAvail / QueueUsed 當成 guest RAM 裡的索引來使用,然後靠 vgpu->ram 直接讀 descriptor table 與 avail/used ring

virtio_gpu_state_t 中的 ram 是 guest RAM 的基底指標,所以存取 descriptor table、avail ring、used ring、裝置組態空間時,全部都會回到這塊記憶體上

而 priv 則指向 virtio_gpu_data_t,裡面存的是 scanout 的寬高與 enable 狀態,屬於 host 在 guest 驅動偵測裝置之前就準備好的裝置資訊。 其對應的結構本體定義在 virtio-gpu.h:

struct vgpu_scanout_info {

uint32_t width;

uint32_t height;

uint32_t enabled;

};

typedef struct {

struct vgpu_scanout_info scanouts[VIRTIO_GPU_MAX_SCANOUTS];

} virtio_gpu_data_t;這裡可以把它理解成「scanout 的靜態裝置資訊表」。 virtio_gpu_state_t 保存的是 MMIO 暫存器、virtqueue 與中斷的相關狀態,virtio_gpu_data_t 則另外保存每個 scanout 的寬、高與 enable 狀態。 兩者之間的關係是:

virtio_gpu_state_t- 保存 guest 驅動透過 MMIO 改動的暫存器與 queue 狀態

virtio_gpu_data_t- 保存 host 端事先準備好的 scanout 資訊

- 這些資訊不會因為 queue reset 而消失

main.c 初始化 virtio-gpu 時,scanout 的基本資料會透過 virtio_gpu_add_scanout() 寫進這張表:

void virtio_gpu_add_scanout(virtio_gpu_state_t *vgpu,

uint32_t width,

uint32_t height)

{

int scanout_num = vgpu_configs.num_scanouts++;

...

PRIV(vgpu)->scanouts[scanout_num].width = width;

PRIV(vgpu)->scanouts[scanout_num].height = height;

PRIV(vgpu)->scanouts[scanout_num].enabled = 1;

...

}也就是說,像 1024x768 這種初始的輸出尺寸,不會放在 vgpu_resource_2d 或 queue 狀態裡。 semu 會先透過 priv 把它登記到 virtio_gpu_data_t.scanouts[],等 guest 驅動偵測裝置、送 GET_DISPLAY_INFO 時,再從這張表把資料回傳給 guest:

void virtio_gpu_get_display_info_handler(virtio_gpu_state_t *vgpu,

struct virtq_desc *vq_desc,

uint32_t *plen)

{

...

int scanout_num = vgpu_configs.num_scanouts;

for (int i = 0; i < scanout_num; i++) {

response->pmodes[i].r.width = PRIV(vgpu)->scanouts[i].width;

response->pmodes[i].r.height = PRIV(vgpu)->scanouts[i].height;

response->pmodes[i].enabled = PRIV(vgpu)->scanouts[i].enabled;

}

...

}從上面這段 GET_DISPLAY_INFO 的 code 可以看出 scanout 的規格資料是從 priv -> virtio_gpu_data_t -> scanouts[] 這條路徑提供給 guest 的,並不是放在 vgpu_resource_2d 裡,也不是放在 virtqueue 的狀態裡

為了避免把不同來源的狀態混在一起,這裡可以把資料分成三類:

virtio_gpu_data_t.scanouts[]:描述裝置宣告自己有幾個 scanout、每個 scanout 的尺寸與 enable 狀態virtio_gpu_queue_t:描述 guest 如何透過 virtqueue 把命令送進來vgpu_resource_2d:描述 guest 真正建立出來的 2D resource,以及它後來被綁到哪個 scanout

由於 priv 和 ram 都是 host 提供給裝置的基礎設施指標,不屬於可重設的裝置狀態,所以在 reset 時它們會被保存下來:

static void virtio_gpu_update_status(virtio_gpu_state_t *vgpu, uint32_t status)

{

vgpu->Status |= status;

if (status)

return;

uint32_t *ram = vgpu->ram;

void *priv = vgpu->priv;

memset(vgpu, 0, sizeof(*vgpu));

vgpu->ram = ram;

vgpu->priv = priv;

/* Release all 2D resources */

...

}相對地,queue 的狀態、feature 的協商與中斷狀態這些都屬於可重設的裝置狀態,所以和 ram、priv 不一樣,會隨著 guest reset 一起被清掉。 另外像 res_2d->scanout_id 這種描述資源目前綁到哪個 scanout 的執行期狀態,也不放在 virtio_gpu_data_t 裡,而是跟著 vgpu_res_2d_list 裡的 2D resource 一起管理,因此同樣會在 reset 時一併釋放

對於 queue 狀態這類的資訊,目前是透過 MMIO 的寫入來逐步建立起來的。 這會在 virtio_gpu_reg_write() 內處理,guest 設 queue 的操作會在這裡做 dispatch:

case _(QueueSel):

if (value < ARRAY_SIZE(vgpu->queues))

vgpu->QueueSel = value;

else

virtio_gpu_set_fail(vgpu);

return true;

case _(QueueNum):

if (value > 0 && value <= VGPU_QUEUE_NUM_MAX)

VGPU_QUEUE.QueueNum = value;

else

virtio_gpu_set_fail(vgpu);

return true;

case _(QueueReady):

VGPU_QUEUE.ready = value & 1;

if (value & 1)

VGPU_QUEUE.last_avail = vgpu->ram[VGPU_QUEUE.QueueAvail] >> 16;

return true;

case _(QueueDescLow):

VGPU_QUEUE.QueueDesc = vgpu_preprocess(vgpu, value);

return true;

case _(QueueDriverLow):

VGPU_QUEUE.QueueAvail = vgpu_preprocess(vgpu, value);

return true;

case _(QueueDeviceLow):

VGPU_QUEUE.QueueUsed = vgpu_preprocess(vgpu, value);

return true;QueueSel 負責決定 guest 目前要配置哪一條 queue,而 VGPU_QUEUE 這個 macro 用來把後續的 QueueNum、QueueDesc、QueueAvail、QueueUsed 都導向 queues[QueueSel],定義如下:

#define VGPU_QUEUE (vgpu->queues[vgpu->QueueSel])接著等到 guest 寫 QueueNotify 時,這些欄位才會真正被消費掉:

static void virtio_queue_notify_handler(virtio_gpu_state_t *vgpu, int index)

{

uint32_t *ram = vgpu->ram;

virtio_gpu_queue_t *queue = &vgpu->queues[index];

uint16_t new_avail = ram[queue->QueueAvail] >> 16;

...

while (queue->last_avail != new_avail) {

uint16_t queue_idx = queue->last_avail % queue->QueueNum;

uint16_t buffer_idx = ram[queue->QueueAvail + 1 + queue_idx / 2] >>

(16 * (queue_idx % 2));

uint32_t len = 0;

int result = virtio_gpu_desc_handler(vgpu, queue, buffer_idx, &len);

if (result != 0)

return;

uint32_t vq_used_addr =

queue->QueueUsed + 1 + (new_used % queue->QueueNum) * 2;

ram[vq_used_addr] = buffer_idx;

ram[vq_used_addr + 1] = len;

queue->last_avail++;

new_used++;

}

}從這段可以看出 virtio_gpu_queue_t 的欄位分工很直接:

QueueNum:決定 ring buffer 的大小與取模方式QueueAvail:指到 avail ring 的起點,讓裝置知道 guest 放了哪些 descriptor indexQueueUsed:指到 used ring 的起點,讓裝置把完成結果寫回去QueueDesc:指到 descriptor table,讓裝置可以沿著 descriptor 鏈讀 request / response bufferlast_avail:記住裝置上次處理到哪裡,避免重複消費同一批 avail entryready:表示 guest 是否已完成這條 queue 的配置,還沒 ready 時,QueueNotify會直接失敗

具體的使用方法,在一開始的「Virtqueue 相關」一節中已經詳細解釋了

如果和 Linux guest 驅動對照,Linux 端通常不會直接碰 avail->ring[] 或 used->ring[] 這些欄位,而是透過 struct virtqueue * 與 virtio core 提供的 helper 來操作 queue

以 virtgpu_vq.c 為例,驅動端平常做的是把 scatterlist 交給 virtqueue_add_sgs(),必要時用 virtqueue_kick_prepare() / virtqueue_notify() 通知裝置,之後再用 virtqueue_get_buf() 收回完成的 buffer:

static int virtio_gpu_queue_ctrl_sgs(struct virtio_gpu_device *vgdev,

struct virtio_gpu_vbuffer *vbuf,

... )

{

struct virtqueue *vq = vgdev->ctrlq.vq;

...

ret = virtqueue_add_sgs(vq, sgs, outcnt, incnt, vbuf, GFP_ATOMIC);

...

}

void virtio_gpu_notify(struct virtio_gpu_device *vgdev)

{

...

notify = virtqueue_kick_prepare(vgdev->ctrlq.vq);

...

if (notify)

virtqueue_notify(vgdev->ctrlq.vq);

}

static void reclaim_vbufs(struct virtqueue *vq, struct list_head *reclaim_list)

{

...

while ((vbuf = virtqueue_get_buf(vq, &len))) {

...

}

}在 Linux 驅動這一層,struct virtqueue 代表的是一條已初始化的 virtqueue 實例,驅動端可以透過它看到 queue 的編號、剩餘空間與 callback 這些執行期資訊,但 split virtqueue 的實際記憶體佈局並不是直接在這一層展開的:

struct virtqueue {

struct list_head list;

void (*callback)(struct virtqueue *vq);

const char *name;

struct virtio_device *vdev;

unsigned int index;

unsigned int num_free;

unsigned int num_max;

bool reset;

void *priv;

};

int virtqueue_add_sgs(struct virtqueue *vq, ...);

bool virtqueue_kick(struct virtqueue *vq);

void *virtqueue_get_buf(struct virtqueue *vq, unsigned int *len);struct virtqueue 內並沒有三個 split virtqueue ring 的成員。 Linux 驅動手上拿到的是公開的 struct virtqueue *。 當驅動呼叫 virtqueue_add_sgs()、virtqueue_get_buf() 這類 helper,控制流程進入 virtio_ring.c 之後,virtio core 會先利用 to_vvq(_vq) 與這個指標回推出外層的 struct vring_virtqueue

如果借用資料結構的術語,這裡可以把它看成一種 intrusive 的佈局:struct virtqueue 不會被獨立配置,只會在 struct vring_virtqueue 內作為成員 vq 出現。 而 to_vvq(_vq) 則是搭配的 container_of 慣用法,可以從成員 vq 的實例位址回推出外層 struct vring_virtqueue 結構本體的起始位址:

struct vring_virtqueue_split {

struct vring vring;

...

};

struct vring_virtqueue {

struct virtqueue vq;

bool packed_ring;

...

union {

struct vring_virtqueue_split split;

...

};

};

#define to_vvq(_vq) container_of_const(_vq, struct vring_virtqueue, vq)接著 virtio core 會看 packed_ring 這個旗標,判斷這條 queue 目前使用的是 packed ring 還是 split ring。 若是 split ring,後續實際使用的就是 union 裡的 split 成員,也就是 vq->split

其中 vq->split.vring 才是實際指向三個 ring 的地方,而 struct vring 本身只是把 split virtqueue 的三塊記憶體收在一起:

struct vring {

unsigned int num;

vring_desc_t *desc;

vring_avail_t *avail;

vring_used_t *used;

};整體的對應關係如下:

展開 call graph

[include/linux/virtio.h:34] struct virtqueue *

│

│ Linux 驅動手上拿到的公開 queue handle

↓

[drivers/virtio/virtio_ring.c:232] to_vvq(_vq)

│

│ container_of_const(_vq, struct vring_virtqueue, vq)

│ 從成員 `vq` 的位址回推出外層 `struct vring_virtqueue`

↓

[drivers/virtio/virtio_ring.c:162] struct vring_virtqueue

│

│ 內含 `struct virtqueue vq;`

│ 再依 `packed_ring` 決定要走 `packed` 還是 `split`

↓

[drivers/virtio/virtio_ring.c:97] vq->split / struct vring_virtqueue_split

│

│ split ring 版本的私有狀態

│ `vq->split.vring` 指向實際 ring layout

↓

[include/uapi/linux/virtio_ring.h:158] struct vring

│

│ 收住三個 ring 的指標

↓

[include/uapi/linux/virtio_ring.h:107] struct vring_desc

[include/uapi/linux/virtio_ring.h:114] struct vring_avail

[include/uapi/linux/virtio_ring.h:131] struct vring_usedstruct vring 指向的三塊 split virtqueue 記憶體佈局如下:

struct vring_desc {

__virtio64 addr;

__virtio32 len;

__virtio16 flags;

__virtio16 next;

};

struct vring_avail {

__virtio16 flags;

__virtio16 idx;

__virtio16 ring[];

};

struct vring_used_elem {

__virtio32 id;

__virtio32 len;

};

struct vring_used {

__virtio16 flags;

__virtio16 idx;

vring_used_elem_t ring[];

};- descriptor table:真正描述 buffer 的地方。 每個

struct vring_desc指出一段 guest buffer 的位址與長度。 如果flags帶有VRING_DESC_F_NEXT,則會沿著next把多個 descriptor 串成一條鏈 - avail ring:驅動會把「哪一條 descriptor 鏈可以讓裝置使用」寫到

struct vring_avail這裡。avail->ring[]裡放的是 descriptor head index,也就是一條鏈的起點。avail->idx則表示驅動目前總共公開了多少筆可用工作 - used ring:裝置做完之後,把「哪一條 descriptor 鏈已經完成」寫到

struct vring_used這裡。used->ring[]裡的每個元素是struct vring_used_elem,裡面記的是 head descriptor 的id與實際處理長度len。used->idx則表示裝置目前總共完成了多少筆工作

如果把一筆 split virtqueue request 的操作順序攤開,大致會是下面這樣:

- 驅動先在 descriptor table 裡準備好一條 descriptor 鏈。 這條鏈描述的是「request buffer 在哪裡、response buffer 在哪裡、哪些 buffer 是裝置可寫入的」

- 這條鏈準備好之後,驅動不會把整條鏈複製到 avail ring,它只會把 head descriptor 的 index 寫進

avail->ring[avail->idx % num],因此 avail ring 裡存的是「descriptor 鏈的起點編號」,不是 descriptor 內容本身 - 接著驅動增加

avail->idx,表示又多公開了一筆工作給裝置。 必要時再透過virtqueue_kick_prepare()/virtqueue_notify()通知裝置 - 裝置看到

avail->idx前進之後,會到avail->ring[]取出這筆工作的 head index,再回到 descriptor table,沿著next把整條 descriptor 鏈走完 - 當裝置做完這筆工作之後,它會把同一個 head index 寫進

used->ring[used->idx % num].id,再把實際處理長度寫進used->ring[used->idx % num].len - 最後裝置增加

used->idx。 驅動之後只要發現used->idx比自己上次看到的大,就知道又有新的完成項目可以回收

descriptor table 比較像是靜態的 buffer 描述區,真正負責「排隊等待裝置消費」的是 avail ring,負責「回報哪些工作已經完成」的是 used ring。 avail / used 兩邊都只會交換 index,而不是直接搬動 descriptor 內容

Linux 的 virtio core 會替驅動處理這些細節。 把 buffer 放進 queue 時,virtqueue_add_split() 會先填好 descriptor,再把 head index 寫進 avail->ring[avail_idx_shadow % num],最後才增加 avail->idx:

static inline int virtqueue_add_split(struct virtqueue *_vq, ...)

{

...

avail = vq->split.avail_idx_shadow & (vq->split.vring.num - 1);

vq->split.vring.avail->ring[avail] =

cpu_to_virtio16(_vq->vdev, head);

...

vq->split.avail_idx_shadow++;

vq->split.vring.avail->idx =

cpu_to_virtio16(_vq->vdev, vq->split.avail_idx_shadow);

...

}而把完成結果取回來時,virtqueue_get_buf_ctx_split() 會透過 more_used_split() 這個 helper 判斷 used->idx 是否有前進:

static bool more_used_split(const struct vring_virtqueue *vq)

{

return vq->last_used_idx != virtio16_to_cpu(vq->vq.vdev,

vq->split.vring.used->idx);

}再從 used->ring[last_used_idx % num] 取出完成的 head index 與長度:

static void *virtqueue_get_buf_ctx_split(struct virtqueue *_vq,

unsigned int *len,

void **ctx)

{

...

if (!more_used_split(vq)) {

...

return NULL;

}

...

last_used = (vq->last_used_idx & (vq->split.vring.num - 1));

i = virtio32_to_cpu(_vq->vdev,

vq->split.vring.used->ring[last_used].id);

*len = virtio32_to_cpu(_vq->vdev,

vq->split.vring.used->ring[last_used].len);

...

vq->last_used_idx++;

...

}把 virtqueue_add_split()、more_used_split() 與 virtqueue_get_buf_ctx_split() 一起看,split virtqueue 裡的 idx 可以這樣理解:

avail->idx與used->idx都是持續遞增的累計計數器,不是 ring array 的直接索引。 前者表示驅動目前總共公開了多少筆工作,後者表示裝置目前總共完成了多少筆工作- 真正落到 ring array 的位置,要用

idx % QueueNum去取模。 Linux virtio core 內部常寫成& (num - 1)(queue size 需要是 2 的冪次)

到了 semu,還會再看到幾個和這套規則對應的實作變數:

queue->last_avail是 semu 自己維護的裝置端處理進度,表示 host 已經處理到第幾筆 avail entry。 只要last_avail != avail->idx,就代表 avail ring 裡還有新的工作沒被消費queue_idx是把last_avail對QueueNum取模之後,得到這一筆工作目前落在 avail ring 的哪一個 slotbuffer_idx則是從avail->ring[queue_idx]取出的 descriptor head index,它指向 descriptor table 裡哪一條 descriptor 鏈,和queue_idx這種 ring slot 編號不是同一件事

在設計上,目前 semu 沒有像 linux virtio core 一樣的函式,而是直接在 virtio_gpu_state_t / virtio_gpu_queue_t 與 uint32_t *ram 等地方直接做位址的計算。 因為 QueueAvail、QueueUsed 存的是 guest RAM 裡的 word index,所以:

ram[queue->QueueAvail]的低 16 位是virtq_avail.flags,高 16 位是virtq_avail.idxram[queue->QueueUsed]的低 16 位是virtq_used.flags,高 16 位是virtq_used.idxavail->ring[]的每個元素是 16-bit descriptor index,因此讀取時要用queue->QueueAvail + 1 + queue_idx / 2找到對應的 32-bit word,再用>> (16 * (queue_idx % 2))取出高半部或低半部used->ring[]的每個元素由兩個 32-bit 的欄位組成:id和len,所以 semu 寫回時會用queue->QueueUsed + 1 + slot * 2當起點,連續寫兩個 word

semu 的 descriptor table 的結構定義在 virtio.h:

PACKED(struct virtq_desc {

uint64_t addr;

uint32_t len;

uint16_t flags;

uint16_t next;

});但 avail ring 與 used ring 沒有另外包成 host 端結構,設計上會直接在 uint32_t *ram 上做位址計算。 這也是為什麼 virtio_gpu_queue_t / virtio_input_queue_t 裡存的 QueueDesc、QueueAvail、QueueUsed 都是 guest RAM 上的索引,而不是 host pointer

以 virtio_input_desc_handler() 為例,讀取下一個 available descriptor 的方式如下:

uint16_t queue_idx = queue->last_avail % queue->QueueNum;

uint16_t buffer_idx = ram[queue->QueueAvail + 1 + queue_idx / 2] >>

(16 * (queue_idx % 2));

desc = &ram[queue->QueueDesc + buffer_idx * 4];

vq_desc.addr = desc[0];

uint32_t addr_high = desc[1];

vq_desc.len = desc[2];

vq_desc.flags = desc[3] & 0xFFFF;而事件寫回 guest buffer 與 used ring 的方式則是:

ev = (struct virtio_input_event *) ((uintptr_t) ram + vq_desc.addr);

ev->type = input_ev[i].type;

ev->code = input_ev[i].code;

ev->value = input_ev[i].value;

uint32_t vq_used_addr =

queue->QueueUsed + 1 + (new_used % queue->QueueNum) * 2;

ram[vq_used_addr] = buffer_idx;

ram[vq_used_addr + 1] = sizeof(struct virtio_input_event);因此目前 semu 是直接把 uint32_t *ram 視角下的 ring 的佈局與位移計算出來。 後面無論是 virtio_queue_notify_handler()、virtio_gpu_desc_handler(),或 virtio_input_desc_handler(),都是用同一套思路在處理 guest 提供的 descriptor 鏈

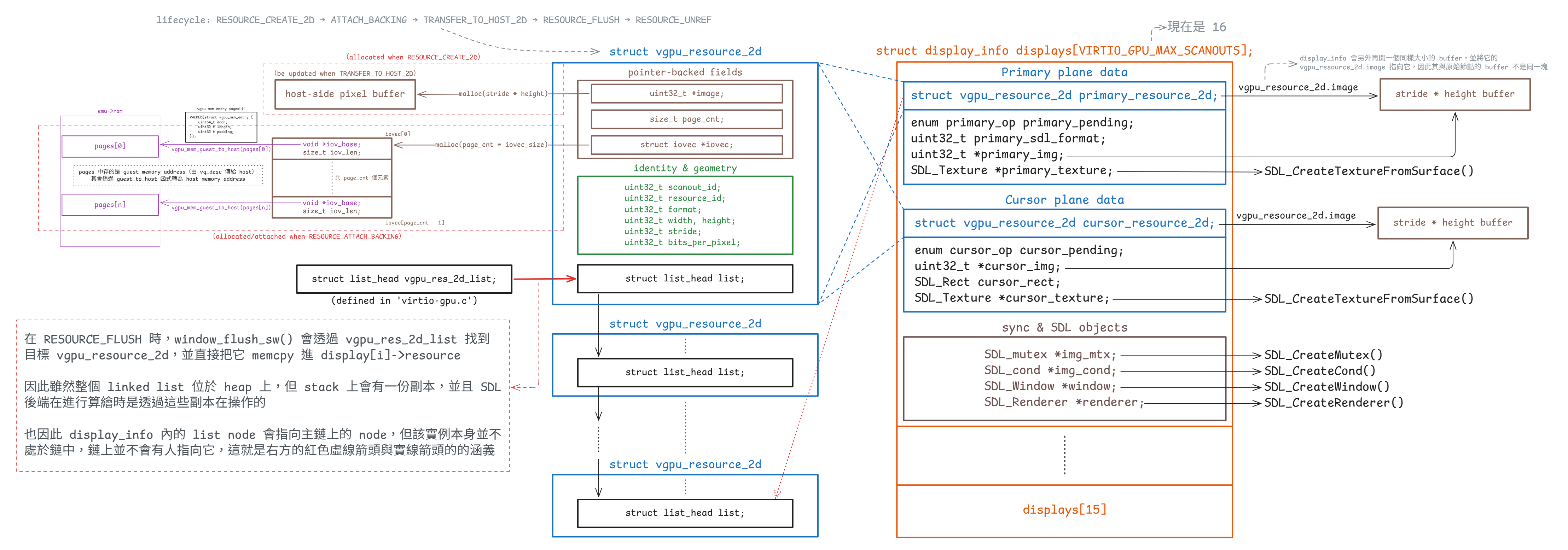

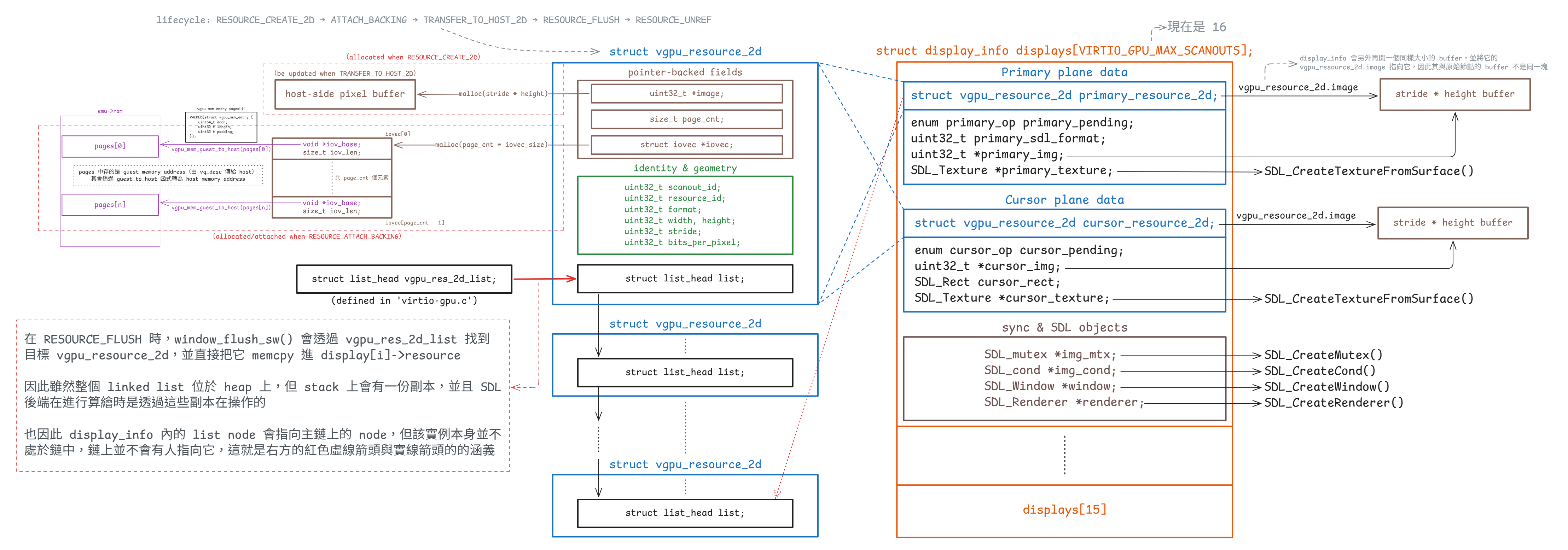

vgpu_resource_2d 與 display_info

display_info 內的 vgpu_resource_2d 是主鏈上的節點的副本)每個 2D resource 都用 struct vgpu_resource_2d 表示(定義於 virtio-gpu.h):

struct vgpu_resource_2d {

uint32_t scanout_id; // Bound scanout ID

uint32_t resource_id; // Resource ID

uint32_t format; // Pixel format, e.g. ARGB8888

uint32_t width, height; // Width and height

uint32_t stride; // Bytes per row

uint32_t bits_per_pixel; // Bits per pixel

uint32_t *image; // Host-side image buffer

size_t page_cnt; // Number of guest-provided memory pages

struct iovec *iovec; // Guest page addresses and lengths

struct list_head list; // Linked-list node

};這個結構本身把目前 2D 路徑最核心的幾件事放在了一起:

resource_id是 guest 看到的資源的 handleformat、width、height、stride與bits_per_pixel決定 host 要怎麼解讀像素image是 semu 自己配置的 host 端的連續 bufferpage_cnt與iovec則是 attach backing 之後,對應到 guest backing pages 的 host 端映射資訊

如果對照 Linux guest 端的 virtio-gpu 驅動,vgpu_resource_2d 其實是在 semu 內把幾個原本分散在 DRM/GEM/virtio-gpu 驅動裡的概念整合成一個 host 端的資源物件

在 Linux 那一側,若要找最接近「資源本體」的結構,應該要看 struct virtio_gpu_object:

struct virtio_gpu_object {

struct drm_gem_shmem_object base;

struct sg_table *sgt;

uint32_t hw_res_handle;

bool dumb;

bool created;

bool attached;

bool host3d_blob, guest_blob;

uint32_t blob_mem, blob_flags;

};這裡的 hw_res_handle 就是 guest 驅動後續送給裝置的 resource_id。 Linux 驅動建立 object 之後,會在 virtio_gpu_cmd_create_resource() 裡把格式與尺寸封裝成 RESOURCE_CREATE_2D:

void virtio_gpu_cmd_create_resource(struct virtio_gpu_device *vgdev,

struct virtio_gpu_object *bo,

struct virtio_gpu_object_params *params,

struct virtio_gpu_object_array *objs,

struct virtio_gpu_fence *fence)

{

cmd_p->hdr.type = cpu_to_le32(VIRTIO_GPU_CMD_RESOURCE_CREATE_2D);

cmd_p->resource_id = cpu_to_le32(bo->hw_res_handle);

cmd_p->format = cpu_to_le32(params->format);

cmd_p->width = cpu_to_le32(params->width);

cmd_p->height = cpu_to_le32(params->height);

}也就是說,在 Linux 端這幾件事情其實分散在不同層:

struct virtio_gpu_object- 持有

hw_res_handle - 持有 backing memory 的 GEM/shmem 狀態與

sg_table

- 持有

struct virtio_gpu_framebuffer:表示 DRM/KMS 看到的 framebufferstruct virtio_gpu_output/ plane 的狀態:表示 scanout、primary plane、cursor plane 的輸出狀態

到了 semu 這邊,裝置端不需要重建完整的 DRM 物件模型,所以 vgpu_resource_2d 直接把裝置真正需要追蹤的資訊收在一起:

- 協定層會直接出現的資源資訊

resource_idformat / width / heightscanout_id

- semu 內部實作需要的 host 端私有狀態

iovec / page_cntimage / stride / bits_per_pixellist

在 Linux guest 端,真正需要決定的是「哪一個資源要顯示到哪一個 scanout,以及要取 source buffer 的哪個矩形區域」這組資訊,而這組資訊可以拆成下面幾點來看:

- 在 Linux guest 端,這組資訊不是

virtio_gpu_object內的某個欄位 virtio_gpu_object只知道自己是哪個資源(透過hw_res_handle)- 「這個資源現在要顯示到哪個 scanout、用多大的矩形、從 source buffer 的哪個區域取資料」這些資訊,是放在 KMS 的 output / crtc 狀態 / plane 狀態裡的

- 等到 atomic update 真正提交時,驅動才把這些狀態組成

SET_SCANOUT命令,排進 virtqueue

對 Linux 的 2D path 而言,primary plane update 的關鍵路徑在 virtio_gpu_primary_plane_update()。 底下只節錄和 2D/dumb buffer、SET_SCANOUT 最相關的部分:

static void virtio_gpu_primary_plane_update(struct drm_plane *plane,

struct drm_atomic_state *state)

{

struct drm_plane_state *old_state = ...;

struct virtio_gpu_device *vgdev = ...;

struct virtio_gpu_output *output = NULL;

struct virtio_gpu_object *bo;

struct drm_rect rect;

...

if (plane->state->crtc)

output = drm_crtc_to_virtio_gpu_output(plane->state->crtc);

bo = gem_to_virtio_gpu_obj(plane->state->fb->obj[0]);

if (bo->dumb)

virtio_gpu_update_dumb_bo(vgdev, plane->state, &rect);

if (plane->state->fb != old_state->fb ||

plane->state->src_w != old_state->src_w ||

plane->state->src_h != old_state->src_h ||

plane->state->src_x != old_state->src_x ||

plane->state->src_y != old_state->src_y ||

output->needs_modeset) {

output->needs_modeset = false;

if (bo->host3d_blob || bo->guest_blob) {

virtio_gpu_cmd_set_scanout_blob(...);

} else {

virtio_gpu_cmd_set_scanout(vgdev, output->index,

bo->hw_res_handle,

plane->state->src_w >> 16,

plane->state->src_h >> 16,

plane->state->src_x >> 16,

plane->state->src_y >> 16);

}

}

virtio_gpu_resource_flush(plane, rect.x1, rect.y1,

rect.x2 - rect.x1, rect.y2 - rect.y1);

}這段流程可以拆成下面幾步:

- 先從

plane->state->crtc找到目前綁定的output output->index就是 scanout id- 再從 framebuffer 往下找到

virtio_gpu_object - 如果這是 2D 的 dumb buffer(我們的情況),先經過

virtio_gpu_update_dumb_bo()佇列化TRANSFER_TO_HOST_2D - 當 framebuffer、source rectangle 或 modeset 狀態改變時,再把

SET_SCANOUT佇列化 - 最後呼叫

virtio_gpu_resource_flush(),在這一步才會真正通知裝置,把前面排進去的命令送出去

換句話說,在 Linux 那邊:

- 資源本身只是一個可被引用的 GPU object

- 2D 的 dumb buffer 路徑會先把

TRANSFER_TO_HOST_2D排進 controlq - scanout 設定是 display pipeline 狀態的一部分

- 到 plane update / modeset 時,資源 ID、scanout ID 與 source rectangle 才會被組合成

SET_SCANOUT - 這些命令在常見路徑下會等到後面的

RESOURCE_FLUSH一起被通知送出

真正送出去的 helper 是 virtio_gpu_cmd_set_scanout():

void virtio_gpu_cmd_set_scanout(struct virtio_gpu_device *vgdev,

uint32_t scanout_id, uint32_t resource_id,

uint32_t width, uint32_t height,

uint32_t x, uint32_t y)

{

cmd_p->hdr.type = cpu_to_le32(VIRTIO_GPU_CMD_SET_SCANOUT);

cmd_p->resource_id = cpu_to_le32(resource_id);

cmd_p->scanout_id = cpu_to_le32(scanout_id);

cmd_p->r.width = cpu_to_le32(width);

cmd_p->r.height = cpu_to_le32(height);

cmd_p->r.x = cpu_to_le32(x);

cmd_p->r.y = cpu_to_le32(y);

}因此,Linux 不會在資源物件上直接記 scanout_id,通常要等 KMS 狀態真的決定了「資源 + source rectangle + output」這組綁定之後,才把 output->index 和 bo->hw_res_handle 一起封裝成命令。 對 2D 的 dumb buffer 來說,常見路徑其實是:

- dumb buffer 對應到

virtio_gpu_object virtio_gpu_update_dumb_bo()先把TRANSFER_TO_HOST_2D排進 queue- 如果 scanout 綁定或 source rectangle 有變,再把

SET_SCANOUT排進 queue - 最後做

RESOURCE_FLUSH,並在這一步通知裝置

更精確地說,Linux 端會先把「目前這個資源顯示到哪個 scanout」保存在顯示管線的狀態裡,不會直接寫進資源物件。 這些狀態主要出現在 struct virtio_gpu_output、crtc 狀態、plane 狀態這一層,之後才被整理成 SET_SCANOUT 命令送到裝置

從 semu 裝置端收到的資訊來看,SET_SCANOUT 已經把 resource_id 和 scanout_id 配對好了,因此 semu 在處理這個命令時,會直接把 scanout_id 寫回 vgpu_resource_2d。 換句話說,Linux 那邊原本分散保存在顯示管線狀態裡的各個資訊,到了 semu 這一側,就被統一放進了 vgpu_resource_2d 這個資源物件裡

對應的實作就是:

/* Bind scanout with resource */

res_2d->scanout_id = request->scanout_id;接著到了 RESOURCE_FLUSH,semu 就可以直接從 res_2d 取回 scanout_id:

struct vgpu_resource_2d *res_2d =

vgpu_get_resource_2d(request->resource_id);

g_window.window_flush(res_2d->scanout_id, request->resource_id);雖然從 guest 端來看,「資源對應到哪個 scanout」原本是靠 KMS 顯示狀態決定的,但從 semu 這個裝置模型來看,這份對應資訊在收到 SET_SCANOUT 之後,就被保存到 vgpu_resource_2d 裡,後續 RESOURCE_FLUSH 或鼠標更新都可以直接使用

所有 2D resource 都掛在 vgpu_res_2d_list 上,由 vgpu_create_resource_2d() 建立並插入串列:

struct vgpu_resource_2d *vgpu_create_resource_2d(uint32_t resource_id)

{

struct vgpu_resource_2d *res = calloc(1, sizeof(struct vgpu_resource_2d));

if (!res)

return NULL;

res->resource_id = resource_id;

list_push(&res->list, &vgpu_res_2d_list);

return res;

}而 SDL 視窗後端層真正用來算繪的狀態則是 display_info(定義於 window-sw.c):

struct display_info {

/* Primary plane */

enum primary_op primary_pending;

struct vgpu_resource_2d primary_res;

uint32_t primary_sdl_format;

uint32_t *primary_img;

SDL_Texture *primary_texture;

/* Cursor plane */

enum cursor_op cursor_pending;

struct vgpu_resource_2d cursor_res;

uint32_t *cursor_img;

SDL_Rect cursor_rect;

SDL_Texture *cursor_texture;

SDL_mutex *img_mtx;

SDL_cond *img_cond;

SDL_Window *window;

SDL_Renderer *renderer;

};這兩個結構屬於不同層次:

vgpu_resource_2d是裝置模型層的標準資源display_info是 SDL 後端層的算繪端快照

Tips

這裡的標準資源,可以理解成裝置模型裡那份能「當作標的」的資源狀態,大家要以它為準。 像 resource_id、格式、尺寸、backing 與 image buffer 都會以 vgpu_resource_2d 為準,其他模組如果要使用這個資源,通常是從這份狀態出發,而不是各自再維護另一份資源狀態

如果將 display_info 與 Linux 那邊做對照,會更容易理解它的角色。 Linux DRM/KMS 並沒有一個完全等價於 display_info 的結構,比較接近的是幾個東西一起配合:

struct virtio_gpu_output {

int index;

struct drm_crtc crtc;

struct drm_connector conn;

struct drm_encoder enc;

struct virtio_gpu_display_one info;

struct virtio_gpu_update_cursor cursor;

bool needs_modeset;

};

struct virtio_gpu_framebuffer {

struct drm_framebuffer base;

struct virtio_gpu_fence *fence;

};也就是說,Linux 端把「資源本體」、「framebuffer」、「scanout/output」、「鼠標狀態」拆到了不同層做處理。 但目前 semu 的 display_info 則把「某個 scanout 現在要拿來畫 primary plane 與鼠標平面的資料」集中到了同一個結構裡

display_info 主要提供三類東西:

- Primary plane

struct vgpu_resource_2d primary_resprimary_sdl_formatprimary_imgprimary_texture

- Cursor plane

struct vgpu_resource_2d cursor_rescursor_imgcursor_rectcursor_texture

- 同步與 SDL 物件

img_mtx/img_condwindow/renderer

在目前的設計裡,SDL 後端不會直接依賴標準資源的 image 指標,而是把 primary plane 與鼠標平面都各自 deep copy 成 primary_img / cursor_img。 如此一來,算繪執行緒讀到的會是自己持有的一份像素副本,因此當 guest 在更新 vgpu_resource_2d.image 時,它就不會讀到更新中的內容

primary plane 的 window_flush_sw() 如下:

display->primary_sdl_format = sdl_format;

memcpy(&display->primary_res, primary_res, sizeof(struct vgpu_resource_2d));

size_t pixels_size = (size_t) primary_res->stride * primary_res->height;

uint32_t *new_img = realloc(display->primary_img, pixels_size);

display->primary_img = new_img;

display->primary_res.image = new_img;

memcpy(new_img, primary_res->image, pixels_size);

display->primary_pending = PRIMARY_FLUSH;

SDL_CondSignal(display->img_cond);鼠標平面 的 cursor_update_sw() 也一樣會複製 metadata,再把像素 copy 到 cursor_img:

memcpy(&display->cursor_res, cursor_res, sizeof(struct vgpu_resource_2d));

size_t pixels_size = (size_t) cursor_res->stride * cursor_res->height;

uint32_t *new_cursor_img = realloc(display->cursor_img, pixels_size);

display->cursor_img = new_cursor_img;

display->cursor_res.image = display->cursor_img;

memcpy(display->cursor_img, cursor_res->image, pixels_size);

display->cursor_pending = CURSOR_UPDATE;

SDL_CondSignal(display->img_cond);但資源的正式狀態仍然以 vgpu_resource_2d 為準,display_info 只是 SDL 端為了算繪而保留的快照與副本。 換句話說,雖然 SDL 這邊使用的像素資料生命週期是由 display_info 管理的,但資源的身分、格式、尺寸、backing 與原始 image buffer 仍然由標準資源管理

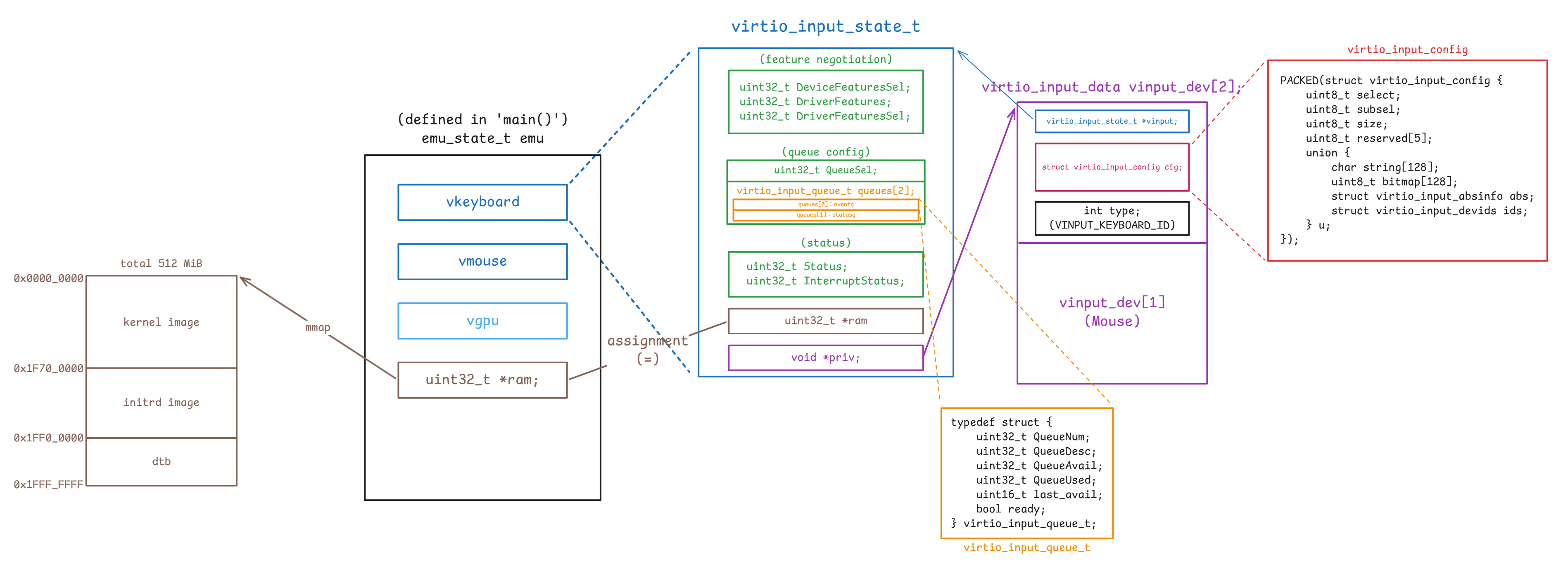

virtio_input_state_t、virtio_input_data 與 virtio_input_config

virtio-input 與 virtio-gpu 差不多,也是把 MMIO 的可見狀態、queue 的狀態與 host 端的私有資料拆開來放,主要差別在於:

- semu 會建兩個獨立的 virtio-input 裝置實例,而不是只有一個輸入裝置

- 每個裝置都有兩條 queue,分別對應 spec 裡的 eventq 與 statusq

先看 queue 和狀態的本體,對應原始碼如下(device.h 與 virtio-input.c):

enum {

VINPUT_KEYBOARD_ID = 0,

VINPUT_MOUSE_ID = 1,

VINPUT_DEV_CNT,

};

enum {

EVENTQ = 0,

STATUSQ = 1,

};

#define VINPUT_QUEUE (vinput->queues[vinput->QueueSel])typedef struct {

uint32_t QueueNum;

uint32_t QueueDesc;

uint32_t QueueAvail;

uint32_t QueueUsed;

uint16_t last_avail;

bool ready;

} virtio_input_queue_t;

typedef struct {

uint32_t DeviceFeaturesSel;

uint32_t DriverFeatures;

uint32_t DriverFeaturesSel;

uint32_t QueueSel;

virtio_input_queue_t queues[2];

uint32_t Status;

uint32_t InterruptStatus;

uint32_t *ram;

void *priv;

} virtio_input_state_t;virtio_input_state_t 的欄位分工和 virtio_gpu_state_t 類似,但這裡保存的是 input 裝置的狀態:

DeviceFeaturesSel、DriverFeatures、DriverFeaturesSel:對應 feature negotiation 相關暫存器QueueSel:表示 guest 目前正在設定哪一條 queuequeues[2]:保存 eventq 與 statusq 各自的 queue layout 與處理進度queues[EVENTQ]:對應到 eventq,裝置用來把鍵盤 / 滑鼠事件送進 guest 的 queuequeues[STATUSQ]:對應到 statusq,guest 用來把 LED 之類的狀態回饋送給裝置的 queue

Status、InterruptStatus:保存裝置狀態與待處理的中斷ram:指向 guest RAM,讓裝置可以直接讀 descriptor table 與 avail/used ringpriv:指向每個 input 裝置自己的virtio_input_data

virtio_input_queue_t 的欄位語意和前面的 virtio_gpu_queue_t 相同:

QueueNum:這條 queue 的 ring 大小QueueDesc:descriptor table 在 guest RAM 裡的起點QueueAvail:avail ring 在 guest RAM 裡的起點QueueUsed:used ring 在 guest RAM 裡的起點last_avail:裝置上次已處理到哪個 avail indexready:guest 是否已完成這條 queue 的配置

但 input 這邊要特別多看一層 queue 身分。 QueueSel 會配合 VINPUT_QUEUE 這個 macro,把同一組 MMIO register 映射到 eventq 或 statusq:

case _(QueueSel):

if (value < ARRAY_SIZE(vinput->queues))

vinput->QueueSel = value;

else

virtio_input_set_fail(vinput);

return true;

case _(QueueNum):

if (value > 0 && value <= VINPUT_QUEUE_NUM_MAX)

VINPUT_QUEUE.QueueNum = value;

else

virtio_input_set_fail(vinput);

return true;

case _(QueueReady):

VINPUT_QUEUE.ready = value & 1;

if (value & 1)

VINPUT_QUEUE.last_avail =

vinput->ram[VINPUT_QUEUE.QueueAvail] >> 16;

return true;和 virtio-gpu 一樣,virtio-input 也沒有另外包一個 host 端的 queue 物件,而是直接把 queue 位置保存成 guest RAM 的索引,等到真正要送事件時再回到 ram 上做位址的計算

不過目前 semu 真正主動使用的是 eventq。 statusq 這條 queue 雖然有完整的 MMIO / queue 狀態欄位,也能被 guest 配置,但目前這個最小實作還沒有去消費 guest 送回來的狀態事件

這個設計也反映在 reset 邏輯上。 virtio_input_update_status() 會把 queue 狀態和 negotiation 狀態清掉,但保留 ram 與 priv:

static void virtio_input_update_status(virtio_input_state_t *vinput,

uint32_t status)

{

vinput->Status |= status;

if (status)

return;

uint32_t *ram = vinput->ram;

void *priv = vinput->priv;

memset(vinput, 0, sizeof(*vinput));

vinput->ram = ram;

vinput->priv = priv;

}這裡和 virtio-gpu 的差別是,virtio-input 沒有像 vgpu_res_2d_list 那樣需要額外釋放的執行期資源串列。 reset 之後保留下來的主要就是:

ram:host 提供的 guest memory 基底指標priv:這個 input 裝置對應到哪一個 host 端的virtio_input_data

接著再看 priv 指到的資料。 對應的結構如下:

PACKED(struct virtio_input_absinfo {

uint32_t min;

uint32_t max;

uint32_t fuzz;

uint32_t flat;

uint32_t res;

});

PACKED(struct virtio_input_devids {

uint16_t bustype;

uint16_t vendor;

uint16_t product;

uint16_t version;

});

PACKED(struct virtio_input_config {

uint8_t select;

uint8_t subsel;

uint8_t size;

uint8_t reserved[5];

union {

char string[128];

uint8_t bitmap[128];

struct virtio_input_absinfo abs;

struct virtio_input_devids ids;

} u;

});

struct virtio_input_data {

virtio_input_state_t *vinput;

struct virtio_input_config cfg;

int type; /* VINPUT_KEYBOARD_ID or VINPUT_MOUSE_ID */

};

static struct virtio_input_data vinput_dev[VINPUT_DEV_CNT];其中 virtio_input_data 是 semu 在 host 端真正拿來區分鍵盤 / 滑鼠的資料物件。 和 virtio-gpu 那邊 priv -> virtio_gpu_data_t 的用法相比,這裡的 priv 更直接:

vinput:指向對應的virtio_input_state_tcfg:保存「目前這次 config 查詢的結果」type:指出這個裝置到底是鍵盤還是滑鼠

和 virtio-gpu 相比,virtio-input 在「資訊怎麼取得」與「queue 拿來做什麼」這兩件事上都不同,這裡最好先分開看

資訊取得方式不同

virtio-input 主要是透過查詢裝置組態欄位(

virtio_input_config)來取得裝置資訊的,不走 virtqueue但 virtio-gpu 則不一樣,它裝置組態欄位(

virtio_gpu_config)的內容很少,真正重要的顯示資訊,例如 display info 或 EDID 等,是透過 controlq 的GET_DISPLAY_INFO、GET_EDID等命令來取得的virtqueue 的語意不同

virtio-input 的兩條 queue 是 eventq 與 statusq。 eventq 用來把裝置產生的輸入事件送進 guest,statusq 則保留給 guest 回傳 LED 或其他狀態更新,所以它們承載的是事件與狀態,不負責查詢裝置資訊

virtio-gpu 的

controlq/cursorq則是命令佇列,guest 會把RESOURCE_CREATE_2D、SET_SCANOUT、TRANSFER_TO_HOST_2D、GET_DISPLAY_INFO、GET_EDID這類請求放進 queue,再由裝置透過 response descriptor 回覆結果

guest 端的 virtio-input 驅動程式需要先知道這個裝置會產生哪些 evdev 事件型別與事件代碼,才能在 guest 作業系統內建立對應的 input 裝置能力宣告,並正確解讀後續從 eventq 收到的 type、code、value

其中 struct virtio_input_config 不會一次把所有資訊都放在裝置組態欄位裡,而是做成一個「查詢介面」。 驅動程式每次想要某一類資訊時,就先把 select 與 subsel 寫進去,裝置再把對應的資料放進 union u,並用 size 告訴你這次回覆了多少 bytes

union u 是「承載該次回覆資料的容器」,同一時間只有一個 union 成員有意義。 對於同一個 virtio_input_config 的實例,驅動透過 select 與 subsel 的不同組合來指定查詢項目後,裝置會把不同型態的資料寫入 union 的某個成員,並用 size 指出這次回覆的有效位元組數:

u.string[128]

放名稱或序號這類字串資訊,實際長度看sizeu.bitmap[128]

放位元集合,常見用法是用 bit 表示是否支援某個 property 或 event code。 位元對應規則通常是 code 值直接對應 bit 位置,例如 code 為 30 就看第 30 個 bit 是否為 1u.abs

放絕對軸參數,對應 evdev 的 ABS 軸資訊語意u.ids

放裝置識別資訊,對應 evdev 常見的裝置 ID 語意

但 virtio-gpu 的 virtio_gpu_config 中沒有 union u 這種「承載回覆資料的容器」,它在裝置組態欄位裡放的是固定欄位:

PACKED(struct vgpu_config {

uint32_t events_read;

uint32_t events_clear;

uint32_t num_scanouts;

uint32_t num_capsets;

});如果要拿更完整的顯示資訊,它沒有辦法只是「改 selector 之後從同一塊裝置組態欄位把資料讀出來」。 對 virtio-gpu 來說,這需要 guest 送 controlq 命令(如 GET_DISPLAY_INFO 或 GET_EDID 等)來查,然後由裝置再用對應的 response struct 回覆,例如 struct vgpu_resp_disp_info 或 struct vgpu_resp_edid 等

回到 virtio-input,這邊 virtio_input_data.cfg 扮演的角色,是 guest 讀取 struct virtio_input_config 時的 host 端暫存區。 當 guest 透過 select 與 subsel 指定要查哪一項資訊後,semu 會把這次查詢的結果寫進這個結構,後續 guest 再去讀裝置組態欄位的對應位址時,實際上讀到的就是這塊 cfg 記憶體

底下的 virtio_input_reg_write() / virtio_input_reg_read() 涵蓋了 guest 查詢這份 config 時會命中的幾個分支:

case VIRTIO_INPUT_REG_SELECT:

PRIV(vinput)->cfg.select = value;

return true;

case VIRTIO_INPUT_REG_SUBSEL:

PRIV(vinput)->cfg.subsel = value;

return true;

case VIRTIO_INPUT_REG_SIZE:

if (!virtio_input_cfg_read(PRIV(vinput)->type))

return false;

*value = PRIV(vinput)->cfg.size;

return true;

default:

...

off_t offset = addr - VIRTIO_INPUT_REG_SELECT;

uint8_t *reg = (uint8_t *) ((uintptr_t) &PRIV(vinput)->cfg + offset);

*value = 0;

memcpy(value, reg, size);

return true;如果把 guest 查一次 config 的存取順序還原出來,大致會是:

- guest 先寫

select,決定要查哪一大類 config - 如果這個大類還需要細分,就再寫

subsel - guest 讀

SIZE時,semu 才真正呼叫virtio_input_cfg_read(),把同一個cfg結構改寫成這次查詢的結果 - 後續 guest 再去讀裝置組態空間的其他位址時,讀到的其實就是剛剛填進

cfg的內容

而 virtio_input_cfg_read() 本身做的,就是根據 type + select + subsel 去改寫 cfg:

static bool virtio_input_cfg_read(int dev_id)

{

struct virtio_input_config *cfg = &vinput_dev[dev_id].cfg;

switch (cfg->select) {

case VIRTIO_INPUT_CFG_ID_NAME:

strcpy(cfg->u.string, vinput_dev_name[dev_id]);

cfg->size = strlen(vinput_dev_name[dev_id]);

return true;

case VIRTIO_INPUT_CFG_ID_DEVIDS:

cfg->u.ids.bustype = BUS_VIRTUAL;

cfg->u.ids.vendor = 0;

cfg->u.ids.product = 0;

cfg->u.ids.version = 1;

cfg->size = sizeof(struct virtio_input_devids);

return true;

case VIRTIO_INPUT_CFG_PROP_BITS:

virtio_input_properties(dev_id);

return true;

case VIRTIO_INPUT_CFG_EV_BITS:

virtio_input_support_events(dev_id, cfg->subsel);

return true;

case VIRTIO_INPUT_CFG_ABS_INFO:

virtio_input_abs_range(dev_id, cfg->subsel);

return true;

...

}

}如前所述,cfg 在不同時間點承載的是不同型態的資料:

- 查

ID_NAME時:cfg->u.string會被填成裝置名稱 - 查

ID_DEVIDS時:cfg->u.ids會被填成 bus/vendor/product/version - 查

PROP_BITS或EV_BITS時:cfg->u.bitmap會被填成 capability bitmap - 查

ABS_INFO時:cfg->u.abs會被填成某個 absolute axis 的範圍資訊

vinput_dev[] 這個靜態陣列有兩個元素,每個元素都是一個 virtio_input_data 的實例,這邊對應到我們的鍵盤與滑鼠,virtio_input_init() 會初始化它們:

void virtio_input_init(virtio_input_state_t *vinput)

{

if (vinput_dev_cnt >= VINPUT_DEV_CNT) {

fprintf(stderr, ...);

exit(2);

}

vinput->priv = &vinput_dev[vinput_dev_cnt];

PRIV(vinput)->type = vinput_dev_cnt;

PRIV(vinput)->vinput = vinput;

vinput_dev_cnt++;

}在 semu 的 main 函式中會固定建立兩個獨立的 virtio-input 裝置實例,然後用初始化順序把它們分別對應到 vinput_dev[] 中預設代表鍵盤與滑鼠的兩個項目:

emu->vkeyboard.ram = emu->ram;

virtio_input_init(&(emu->vkeyboard));

emu->vmouse.ram = emu->ram;

virtio_input_init(&(emu->vmouse));這個順序對照到了 type 的值,使其與初始化的順序相同:

- 第一次

virtio_input_init():type == VINPUT_KEYBOARD_ID(0) - 第二次

virtio_input_init():type == VINPUT_MOUSE_ID(1)

而上方 virtio_input_config 的實作內也可以看到,我們會根據 type 的值(dev_id 參數)來調整要回傳的 config

總的來說,這幾個結構的分工可以整理成:

virtio_input_state_t:保存 MMIO / virtqueue 狀態virtio_input_data:保存裝置實例身分與目前的 config 回覆內容virtio_input_config:guest 透過裝置組態欄位實際讀到的資料格式virtio_input_config的 spec 面:layout 必須和 spec 的 config 區塊一致,guest 才能按位址讀取virtio_input_config的 semu 面:它同時也是每個輸入裝置的查詢結果快取

流程

初始化流程

這節會來討論 guest 和 host 之間的畫面與輸入資料,到底是怎麼穿過 main.c、MMIO、virtqueue、SDL 後端的。 對目前的 semu 而言,這條路徑的第一個分流點是 feature.h 裡透過 Makefile 來設定的編譯期 feature macro:

#ifndef SEMU_FEATURE_VIRTIOGPU

#define SEMU_FEATURE_VIRTIOGPU 1

#endif

#ifndef SEMU_FEATURE_VIRTIOINPUT

#define SEMU_FEATURE_VIRTIOINPUT 1

#endif

#define SEMU_HAS(x) SEMU_FEATURE_##xmain.c 內所有和視窗、輸入、IRQ 接線有關的分支,幾乎都包在 #if SEMU_HAS(VIRTIOGPU) 或 #if SEMU_HAS(VIRTIOINPUT) 裡,需要啟用它們才有辦法使用後面提的 emu->vgpu、emu->vkeyboard、emu->vmouse

semu_init() 內的裝置建立順序

在 main.c 中:

emu_state_t emu;

ret = semu_init(&emu, argc, argv);接著在 semu_init 中:

#if SEMU_HAS(VIRTIOGPU)

emu->vgpu.ram = emu->ram;

virtio_gpu_init(&(emu->vgpu));

virtio_gpu_add_scanout(&(emu->vgpu), SCREEN_WIDTH, SCREEN_HEIGHT);

g_window.window_init();

#endif

#if SEMU_HAS(VIRTIOINPUT)

emu->vkeyboard.ram = emu->ram;

virtio_input_init(&(emu->vkeyboard));

emu->vmouse.ram = emu->ram;

virtio_input_init(&(emu->vmouse));

#endif這裡可以直接看出三件事:

所有 VirtIO 裝置的狀態最先被注入的共同環境,都是

emu->ram。virtio_gpu_state_t.ram和virtio_input_state_t.ram都只是 guest RAM 的 host 端起點。 之後不管是 queue descriptor 或 config 的讀寫,還是 event buffer / response buffer 的讀寫,最終都是在操作這塊記憶體scanout 的預設規格會由

virtio_gpu_add_scanout()根據device.h裡的SCREEN_WIDTH/SCREEN_HEIGHT先建好,guest 端並不負責設定這組初值:#define SCREEN_WIDTH 1024 #define SCREEN_HEIGHT 768也就是說,guest 在偵測 virtio-gpu 裝置時讀到的第一組顯示能力,實際上來自 host 端在

semu_init()裡設定好的 scanout 規格,而不是從某個執行期資源反推回來的g_window.window_init()出現在virtio_gpu_add_scanout()之後。window-sw.c的window_init_sw()會依照目前已有的display_cnt建立每個 scanout 的SDL_Window、SDL_Renderer、img_mtx、img_cond。 因此它需要在 scanout 已經宣告完畢之後,才能正確地建立視窗後端。 這層抽象介面本身定義在window.h:struct window_backend { void (*window_init)(void); void (*window_add)(uint32_t width, uint32_t height); void (*window_set_scanout)(int scanout_id, uint32_t texture_id); void (*window_clear)(int scanout_id); void (*window_flush)(int scanout_id, int res_id); void (*cursor_clear)(int scanout_id); void (*cursor_update)(int scanout_id, int res_id, int x, int y); void (*cursor_move)(int scanout_id, int x, int y); void (*window_main_loop)(void); void (*window_shutdown)(void); };

把這個介面和前半段的 display_info 放在一起看,就能看出目前的分工:virtio-gpu-sw.c 處理的是裝置模型語意,而真正的 SDL 視窗、紋理與事件迴圈都被藏在 g_window 後面

virtio_input_init() 不會動態建立新的輸入裝置物件

virtio-input 這邊的初始化表面上很短,但語意和 virtio-gpu 不太一樣。 不像 virtio_gpu_add_scanout() 會替顯示裝置登記一個新的 scanout 規格,virtio_input_init() 不會動態建立新的輸入裝置物件,而是把 main.c 裡既有的兩個 virtio_input_state_t,接到 virtio-input.c 內預先準備好的靜態 host 端狀態,這些靜態狀態一開始就已經宣告好了:

#define VINPUT_KEYBOARD_NAME "VirtIO Keyboard"

#define VINPUT_MOUSE_NAME "VirtIO Mouse"

...

static struct virtio_input_data vinput_dev[VINPUT_DEV_CNT];

static char *vinput_dev_name[VINPUT_DEV_CNT] = {

VINPUT_KEYBOARD_NAME,

VINPUT_MOUSE_NAME,

};之後在 semu_init() 內會把 ram 指標塞進兩個 virtio_input_state_t,然後各自呼叫一次 virtio_input_init():

#if SEMU_HAS(VIRTIOINPUT)

emu->vkeyboard.ram = emu->ram;

virtio_input_init(&(emu->vkeyboard));

emu->vmouse.ram = emu->ram;

virtio_input_init(&(emu->vmouse));

#endif接著 virtio_input_init() 再把這兩個 MMIO 的可見狀態依序掛到 vinput_dev[]:

void virtio_input_init(virtio_input_state_t *vinput)

{

static int vinput_dev_cnt = 0;

if (vinput_dev_cnt >= VINPUT_DEV_CNT) {

...

}

vinput->priv = &vinput_dev[vinput_dev_cnt];

PRIV(vinput)->type = vinput_dev_cnt;

PRIV(vinput)->vinput = vinput;

vinput_dev_cnt++;

}如果把這段 code 拆開來看,它實際上做了三件事:

vinput->priv = &vinput_dev[vinput_dev_cnt];- 把這個 MMIO 裝置狀態接到對應的 host 端 slot

PRIV(vinput)->type = vinput_dev_cnt;- 用 slot 的編號決定這個裝置在 semu 內部代表鍵盤還是滑鼠

PRIV(vinput)->vinput = vinput;- 讓

virtio_input_data之後能反向找到自己的virtio_input_state_t

- 讓

因此初始化完成後,main.c 會同時握有三個彼此平行的 VirtIO 裝置狀態:

emu.vgpuemu.vkeyboardemu.vmouse

其中 emu.vkeyboard 和 emu.vmouse 雖然都走 virtio-input.c,但它們是兩個獨立的 MMIO 裝置實例,各自有自己的 queue、InterruptStatus 與 config 讀寫路徑。 另一方面,vinput_dev[] 並不是另外再模擬出兩顆新的 VirtIO 裝置,比較像是這兩個裝置背後各自對應的一份 host 端的暫存狀態,可以回到前面去看架構圖來幫助理解

換句話說,初始化之後的配對關係可以寫成:

emu->vkeyboard<->vinput_dev[0]emu->vmouse<->vinput_dev[1]

後面不管是 virtio_input_cfg_read() 要回傳 ID_NAME、EV_BITS,還是 virtio_queue_event_update() 要把事件寫進 eventq,都是先透過 dev_id 找到 vinput_dev[] 內對應的元素,再從 vinput_dev[dev_id].vinput 找到 emu->vkeyboard 或 emu->vmouse 實例

main() 與 emu_thread_func() 的主執行緒模型

如果啟用了 virtio-gpu,main() 就不直接在主執行緒呼叫 semu_run(),而是會在背景執行緒跑虛擬機器,主執行緒跑 SDL 事件迴圈:

static void *emu_thread_func(void *arg)

{

emu_state_t *emu = (emu_state_t *) arg;

int ret;

if (emu->debug)

ret = semu_run_debug(emu);

else

ret = semu_run(emu);

if (g_window.window_shutdown)

g_window.window_shutdown();

return (void *) (intptr_t) ret;

}

int main(int argc, char **argv)

{

...

#if SEMU_HAS(VIRTIOGPU)

if (g_window.window_main_loop) {

pthread_t emu_thread;

void *thread_ret;

if (pthread_create(&emu_thread, NULL, emu_thread_func, &emu) != 0) {

fprintf(stderr, "Failed to create emulator thread\n");

return 1;

}

g_window.window_main_loop();

pthread_join(emu_thread, &thread_ret);

ret = (int) (intptr_t) thread_ret;

} else

#endif

{

...

}

}這麼做的原因是大部分的 SDL 事件都需要在主執行緒上執行,對 GUI 相關的函式更是如此,且這一點在 macOS 上尤為嚴格。 現在整體架構已經統一採用了這個模型:主執行緒持有 SDL 視窗生命週期,背景執行緒則執行 semu_run()、跑 guest 指令、更新 MMIO 與中斷

具體 call graph 如下:

展開 call graph

[main.c:1653] main()

│

├─ [main.c:785] semu_init()

│ │

│ ├─ 配置 RAM,載入 kernel / dtb / initrd,建立 hart 與 VM

│ │

│ ├─ #if SEMU_HAS(VIRTIOGPU)

│ │ ↓

│ │ [virtio-gpu.c:804] virtio_gpu_init()

│ │ ↓

│ │ [virtio-gpu.c:809] virtio_gpu_add_scanout()

│ │ 使用 [device.h] SCREEN_WIDTH / SCREEN_HEIGHT 建立預設 scanout

│ │ ↓

│ │ [window-sw.c:179] window_init_sw()

│ │ 透過 g_window.window_init() 建立 SDL window / renderer / mutex / cond

│ │

│ └─ #if SEMU_HAS(VIRTIOINPUT)

│ ↓

│ [virtio-input.c:731] virtio_input_init()

│ 初始化 emu.vkeyboard

│ 初始化 emu.vmouse

│

├─ [main.c:1674] pthread_create(..., emu_thread_func, ...)

│

├─ main thread

│ ↓

│ [window-sw.c:51] window_main_loop_sw()

│ 主執行緒處理 SDL 視窗與事件

│

└─ background thread

↓

[main.c:1636] emu_thread_func()

↓

[main.c:1195] semu_run() / semu_run_debug()

背景執行緒執行 guest 指令與 peripheral 更新把這張圖和前半段的資料結構一起看,會更容易把角色分開:virtio_gpu_state_t / virtio_input_state_t 是裝置可見的狀態,virtio_gpu_data_t / virtio_input_data 則是 host 端裝置補充狀態,而 g_window 則是把 virtio-gpu 的結果接到 SDL 後端的介面

這一節的重點先到執行緒模型為止:主執行緒掌管 SDL 視窗生命週期,背景執行緒負責 semu_run() 與 guest/peripheral 執行。 至於 virtio-gpu、virtio-input 各自何時更新 InterruptStatus,以及 main.c 怎麼把這些 bit 映射成 PLIC line,會在後面的畫面流程、輸入流程與中斷流程再分別展開

MMIO 與執行模型

main.c 內不只負責 address decode,也同時決定了裝置狀態要放在哪裡、IRQ 什麼時候同步到 PLIC、SDL 主迴圈和虛擬機器的執行迴圈怎麼分工。 這邊讓我們來具體看一下 device.h 裡那幾個 virtio_gpu_state_t / virtio_input_state_t / plic_state_t 是怎麼被串起來的

先看 MMIO mapping,在 0xF_______ 這段 MMIO 的位址空間裡,每個裝置都占用了一段 1 MiB(= 2^20 bytes)大小的位址範圍,因此對於這段空間,我們首先想要的是位址的 bits [27:20]

所以只要 guest 碰到 0xF_______ 區間,mem_load() / mem_store() 就會先做 (addr >> 20) & MASK(8) 把裝置內部的偏移量去掉,再保留最低的 8 bit,這樣取出來的值剛好就是:

0x49:emu.vgpu0x50:emu.vkeyboard0x51:emu.vmouse

以達到將請求分派給各裝置的目的,對應的 MMIO dispatch code 片段如下:

static void mem_load(hart_t *hart,

uint32_t addr,

uint8_t width,

uint32_t *value)

{

...

if ((addr >> 28) == 0xF) {

switch ((addr >> 20) & MASK(8)) {

case 0x49:

virtio_gpu_read(hart, &data->vgpu, addr & 0xFFFFF, width, value);

emu_update_vgpu_interrupts(hart->vm);

return;

case 0x50:

virtio_input_read(hart, &data->vkeyboard, addr & 0xFFFFF, width,

value);

emu_update_vinput_keyboard_interrupts(hart->vm);

return;

case 0x51:

virtio_input_read(hart, &data->vmouse, addr & 0xFFFFF, width,

value);

emu_update_vinput_mouse_interrupts(hart->vm);

return;

...

}

}

...

}

static void mem_store(hart_t *hart,

uint32_t addr,

uint8_t width,

uint32_t value)

{

...

if ((addr >> 28) == 0xF) {

switch ((addr >> 20) & MASK(8)) {

case 0x49:

virtio_gpu_write(hart, &data->vgpu, addr & 0xFFFFF, width, value);

emu_update_vgpu_interrupts(hart->vm);

return;

case 0x50:

virtio_input_write(hart, &data->vkeyboard, addr & 0xFFFFF, width,

value);

emu_update_vinput_keyboard_interrupts(hart->vm);

return;

case 0x51:

virtio_input_write(hart, &data->vmouse, addr & 0xFFFFF, width,

value);

emu_update_vinput_mouse_interrupts(hart->vm);

return;

...

}

}

...

}MMIO access 規則本身就帶有裝置語意

virtio-gpu 和 virtio-input 雖然都掛在 VirtIO MMIO transport 上,但兩邊對暫存器讀寫寬度的限制並不完全一樣。 virtio-gpu.c 採用的是最保守的 32-bit 模型:只有 LW / SW 合法,LB / LH 這類較窄的存取一律視為未對齊。 queue address 的高 32 bit 也必須是 0,否則 virtio_gpu_set_fail() 會把裝置推進 DEVICE_NEEDS_RESET

virtio-input 則把兩段位址分開處理。 virtio_input_read() / virtio_input_write() 會先判斷這次碰到的是不是裝置組態空間(0x100),再套用不同的對齊規則:

0x100之前的通用暫存器:只允許對齊的 32-bitLW/SW0x100與之後的裝置組態空間:允許 8/16/32-bit,只要符合自然對齊即可

這個差異直接關係到 virtio_input_config 能不能滿足規格要求的逐 byte、逐 halfword 讀取的行為,在 code 裡寫得很直接:

void virtio_input_read(hart_t *vm,

virtio_input_state_t *vinput,

uint32_t addr,

uint8_t width,

uint32_t *value)

{

...

pthread_mutex_lock(&virtio_input_mutex);

...

is_cfg = vinput_is_config_access(addr, access_size);

if (!is_cfg) {

if (access_size != 4 || (addr & 0x3)) {

vm_set_exception(vm, RV_EXC_LOAD_MISALIGN, vm->exc_val);

goto out;

}

} else {

if (addr & (access_size - 1)) {

vm_set_exception(vm, RV_EXC_LOAD_MISALIGN, vm->exc_val);

goto out;

}

}

...

out:

pthread_mutex_unlock(&virtio_input_mutex);

}另外,因為 guest 查詢裝置組態空間的過程,和 host 注入輸入事件的過程,都可能同時碰到同一份 virtio_input_data,所以這邊用了 virtio_input_mutex 把這兩邊一起保護起來

Guest 畫面輸出流程

畫面輸出的流程有很明確的主軸:guest 先透過 controlq 建立一個以 resource_id 識別的 2D resource,讓裝置知道這塊畫面資源的格式、寬高與後續要操作的對象,接著再用 RESOURCE_ATTACH_BACKING 把 guest 端實際承載像素資料的 backing pages 掛到這個資源上

等這兩步都完成之後,裝置才會把像素資料搬到 host 端的 vgpu_resource_2d.image,最後再透過 SET_SCANOUT / RESOURCE_FLUSH 讓 SDL 後端看到這份新影像

controlq 入口:QueueNotify 到 virtio_gpu_desc_handler()

在 transport 層,guest 會先透過 MMIO register 把這條 queue 的 QueueNum、QueueDesc、QueueAvail、QueueUsed 與 QueueReady 設好。 之後在 guest 對 controlq 發起 QueueNotify 的請求時,virtio-gpu 便會開始處理 queue 內的請求:

PACKED(struct virtq_desc {

uint64_t addr;

uint32_t len;

uint16_t flags;

uint16_t next;

});

#define VIRTIO_DESC_F_NEXT 1

#define VIRTIO_DESC_F_WRITE 2

case _(QueueNotify):

if (value < ARRAY_SIZE(vgpu->queues))

virtio_queue_notify_handler(vgpu, value);

else

virtio_gpu_set_fail(vgpu);

return true;接著 virtio_queue_notify_handler() 會從 avail ring 取出 head descriptor index,回頭沿著 descriptor table 組出一條最多三段的 descriptor 鏈,最後交給 virtio_gpu_desc_handler():

static void virtio_queue_notify_handler(virtio_gpu_state_t *vgpu, int index)

{

...

while (queue->last_avail != new_avail) {

uint16_t queue_idx = queue->last_avail % queue->QueueNum;

uint16_t buffer_idx = ram[queue->QueueAvail + 1 + queue_idx / 2] >>

(16 * (queue_idx % 2));

uint32_t len = 0;

int result = virtio_gpu_desc_handler(vgpu, queue, buffer_idx, &len);

if (result != 0)

return;

uint32_t vq_used_addr =

queue->QueueUsed + 1 + (new_used % queue->QueueNum) * 2;

ram[vq_used_addr] = buffer_idx;

ram[vq_used_addr + 1] = len;

queue->last_avail++;

new_used++;

}

...

}這裡的 virtq_desc 來自 virtio.h,而 split virtqueue 的 ring 索引計算則完全沿用前半段已經說過的 uint32_t *ram 視角:buffer_idx 是 avail ring 裡的 head descriptor index,vq_used_addr 則是 used ring 中本次完成項目應該落到的 slot

virtio_gpu_desc_handler() 本身沒有區分初始化命令、畫面命令與鼠標命令,它只負責看 header->type,再把控制權交給 g_vgpu_backend:

switch (header->type) {

VGPU_CMD(GET_DISPLAY_INFO, get_display_info)

VGPU_CMD(RESOURCE_CREATE_2D, resource_create_2d)

VGPU_CMD(RESOURCE_UNREF, resource_unref)

VGPU_CMD(SET_SCANOUT, set_scanout)

VGPU_CMD(RESOURCE_FLUSH, resource_flush)

VGPU_CMD(TRANSFER_TO_HOST_2D, transfer_to_host_2d)

VGPU_CMD(RESOURCE_ATTACH_BACKING, resource_attach_backing)

VGPU_CMD(RESOURCE_DETACH_BACKING, resource_detach_backing)

...

VGPU_CMD(UPDATE_CURSOR, update_cursor)

VGPU_CMD(MOVE_CURSOR, move_cursor)

default:

virtio_gpu_cmd_undefined_handler(vgpu, vq_desc, plen);

return -1;

}具體 call graph 如下:

展開 call graph

VirtIO-GPU 中斷路徑

========================

guest MMIO write: QueueNotify

↓

[virtio-gpu.c:673] virtio_gpu_reg_write()

↓

[virtio-gpu.c:534] virtio_queue_notify_handler()

│

├─ 1. 若沒有新的 avail entry

│ ↓

│ 直接返回,不更新 InterruptStatus

├─ 2. 若真的消費到請求

│ ├─ 消費 avail ring / descriptor 鏈

│ ├─ 呼叫 [virtio-gpu.c:449] virtio_gpu_desc_handler()

│ ├─ 寫回 used ring

│ └─ 若未設 VIRTQ_AVAIL_F_NO_INTERRUPT

│ ↓

│ vgpu->InterruptStatus |= VIRTIO_INT__USED_RING

├─ 3. 若進到 fail path

│ ↓

│ [virtio-gpu.c:168] virtio_gpu_set_fail()

│ ↓

│ vgpu->InterruptStatus |= VIRTIO_INT__CONF_CHANGE

↓

後續由 [main.c:111] emu_update_vgpu_interrupts() 讀取 InterruptStatus

↓

data->plic.active |= IRQ_VGPU_BIT

↓

plic_update_interrupts()這張 call graph 的重點是:在 virtio-gpu 裡,queue 是標準的命令佇列。 guest 一旦寫 QueueNotify,裝置就會立刻往下消費 descriptor 鏈。 與後面我們會看到的 virtio-input 不一樣,它的 eventq 是由 host 事件來主動推進的

同一條 controlq path 也決定了 virtio-gpu 的 VIRTIO_INT__USED_RING 何時有資格被設起來,它的處理可以分兩段來看:

第一段發生在裝置自己的實作裡

virtio-gpu.c只負責維護標準 VirtIO 暫存器狀態,會在適當的時機設置InterruptStatus- 以 virtio-gpu 來說,guest 寫

QueueNotify之後會進到virtio_gpu_reg_write(),並呼叫virtio_queue_notify_handler(),如果真的有從 avail ring 取到新的請求、消費 descriptor 鏈、寫回 used ring,就會設置VIRTIO_INT__USED_RING- 如果

QueueNotify進來時其實沒有新的 avail entry,函式會直接返回,不會更新InterruptStatus - 即使真的完成了一筆請求,如果 guest 設了

VIRTQ_AVAIL_F_NO_INTERRUPT,也不會設VIRTIO_INT__USED_RING - 如果裝置進入 fail path,則會由

virtio_gpu_set_fail()設VIRTIO_INT__CONF_CHANGE

- 如果

第二段發生在幾個 helper 裡,負責把 VirtIO 裝置的中斷狀態映射到 semu 的 PLIC 中斷控制器

emu_update_vgpu_interrupts()、emu_update_vinput_keyboard_interrupts()、emu_update_vinput_mouse_interrupts()會讀取各自裝置狀態上的InterruptStatus- 接著把這個狀態映射到

data->plic.active內對應的 bit,最後呼叫plic_update_interrupts() - 也就是說,畫面與輸入裝置本身不會直接改動 PLIC,它們只更新自己的 VirtIO interrupt bit,真正把這些 bit 轉成平台中斷來源的是上面這三個 IRQ 更新函式

有關這三個函式,後面講中斷的時候會再詳細提它

資源建立與 backing:從 resource_id 走到 iovec[]

2D 路徑的資源生命週期是從 RESOURCE_CREATE_2D 開始的,這一步會先建立 vgpu_resource_2d、決定像素格式、計算 stride,並配置一塊 host 端的連續影像緩衝區:

static void virtio_gpu_resource_create_2d_handler(virtio_gpu_state_t *vgpu,

struct virtq_desc *vq_desc,

uint32_t *plen)

{

...

struct vgpu_resource_2d *res_2d =

vgpu_create_resource_2d(request->resource_id);

...

switch (request->format) {

case VIRTIO_GPU_FORMAT_B8G8R8A8_UNORM:

case VIRTIO_GPU_FORMAT_B8G8R8X8_UNORM:

case VIRTIO_GPU_FORMAT_A8R8G8B8_UNORM:

case VIRTIO_GPU_FORMAT_X8R8G8B8_UNORM:

case VIRTIO_GPU_FORMAT_R8G8B8A8_UNORM:

case VIRTIO_GPU_FORMAT_X8B8G8R8_UNORM:

case VIRTIO_GPU_FORMAT_A8B8G8R8_UNORM:

case VIRTIO_GPU_FORMAT_R8G8B8X8_UNORM:

bits_per_pixel = 32;

break;

default:

...

}

res_2d->width = request->width;

res_2d->height = request->height;

res_2d->format = request->format;

res_2d->bits_per_pixel = bits_per_pixel;

res_2d->stride =

((request->width * bits_per_pixel + 0x1f) >> 5) * sizeof(uint32_t);

...

res_2d->image = malloc(image_size);

...

}這裡的 vgpu_create_resource_2d() 會把新物件掛進 vgpu_res_2d_list,而這條 list 的基本操作來自 utils.h 的 Linux-like list helper。 因此建好資源之後,後面所有用 resource_id 找對應 vgpu_resource_2d 的操作,都是沿著這條 host 端的 linked list 在做的

接著 RESOURCE_ATTACH_BACKING 會把 guest 提供的 page list 轉成 iovec[]:

static void virtio_gpu_cmd_resource_attach_backing_handler(

virtio_gpu_state_t *vgpu,

struct virtq_desc *vq_desc,

uint32_t *plen)

{

...

struct vgpu_res_attach_backing *backing_info = vgpu_mem_guest_to_host(

vgpu, vq_desc[0].addr, sizeof(struct vgpu_res_attach_backing));

...

struct vgpu_mem_entry *pages = vgpu_mem_guest_to_host(

vgpu, vq_desc[1].addr,

sizeof(struct vgpu_mem_entry) * backing_info->nr_entries);

...

res_2d->page_cnt = backing_info->nr_entries;

res_2d->iovec = malloc(sizeof(struct iovec) * backing_info->nr_entries);

...

for (size_t i = 0; i < backing_info->nr_entries; i++) {

res_2d->iovec[i].iov_base =

vgpu_mem_guest_to_host(vgpu, pages[i].addr, pages[i].length);

res_2d->iovec[i].iov_len = pages[i].length;

...

}

...

}這裡要先注意一點。 spec 中的原文是:

Request data is

struct virtio_gpu_resource_attach_backing, followed bystruct virtio_gpu_mem_entry entries.

因此 spec 只規定了 request data 的內容順序:前半段是 virtio_gpu_resource_attach_backing,後面接 virtio_gpu_mem_entry[],它並沒有規定這些資料在 virtqueue 裡一定是兩個 descriptor,這段請求資料完全有可能只花一個 descriptor 或多個 descriptor

semu 這裡直接讀 vq_desc[0] 和 vq_desc[1],對齊的是 Linux kernel 內 RESOURCE_ATTACH_BACKING 這條路徑的實作。 Linux 在 virtio_gpu_cmd_resource_attach_backing() 中,它先把 command header 寫進了 cmd_p,再把 ents 放進 vbuf->data_buf:

static void

virtio_gpu_cmd_resource_attach_backing(struct virtio_gpu_device *vgdev,

uint32_t resource_id,

struct virtio_gpu_mem_entry *ents,

uint32_t nents,

struct virtio_gpu_fence *fence)

{

struct virtio_gpu_resource_attach_backing *cmd_p;

struct virtio_gpu_vbuffer *vbuf;

cmd_p = virtio_gpu_alloc_cmd(vgdev, &vbuf, sizeof(*cmd_p));

memset(cmd_p, 0, sizeof(*cmd_p));

cmd_p->hdr.type = cpu_to_le32(VIRTIO_GPU_CMD_RESOURCE_ATTACH_BACKING);

cmd_p->resource_id = cpu_to_le32(resource_id);

cmd_p->nr_entries = cpu_to_le32(nents);

vbuf->data_buf = ents;

vbuf->data_size = sizeof(*ents) * nents;

virtio_gpu_queue_fenced_ctrl_buffer(vgdev, vbuf, fence);

}接著在 virtio_gpu_queue_fenced_ctrl_buffer() 中,又分別用 sg_init_one(&vcmd, vbuf->buf, vbuf->size) 和 sg_init_one(&vout, vbuf->data_buf, vbuf->data_size) 建出兩段請求資料的 scatter-gather 項目,另外再加一段用來寫回回應的 scatter-gather 項目:

static int virtio_gpu_queue_fenced_ctrl_buffer(struct virtio_gpu_device *vgdev,

struct virtio_gpu_vbuffer *vbuf,

struct virtio_gpu_fence *fence)

{

struct scatterlist *sgs[3], vcmd, vout, vresp;

...

/* set up vcmd */

sg_init_one(&vcmd, vbuf->buf, vbuf->size);

sgs[outcnt] = &vcmd;

outcnt++;

/* set up vout */

if (vbuf->data_size) {

...

sg_init_one(&vout, vbuf->data_buf, vbuf->data_size);

sgs[outcnt] = &vout;

outcnt++;

}

/* set up vresp */

if (vbuf->resp_size) {

sg_init_one(&vresp, vbuf->resp_buf, vbuf->resp_size);

sgs[outcnt + incnt] = &vresp;

incnt++;

}

...

}從這條路徑可以看出,在 Linux kernel 處理 RESOURCE_ATTACH_BACKING 的常見做法裡,request header 和 virtio_gpu_mem_entry[] 會分開放進兩段 request descriptor

這裡還有一個值得多看一眼的分支:如果 vbuf->data_buf 落在 vmalloc 區,Linux 就不再直接用 sg_init_one(&vout, ...) 把整段 virtio_gpu_mem_entry[] 視為一個連續的資料區塊,而是會先把這塊 vmalloc 的記憶體拆成 sg_table。 原因在於 vmalloc 配置出來的虛擬位址雖然在 CPU 看起來是連續的,但背後對應的實體頁面不一定連續,因此送進 virtqueue 之前,要先把它還原成一段一段以 page 為單位的 scatter-gather 項目

對應的 Linux code 在 vmalloc_to_sgt() 裡會這樣做:

static struct sg_table *vmalloc_to_sgt(char *data, uint32_t size, int *sg_ents)

{

...

*sg_ents = DIV_ROUND_UP(size, PAGE_SIZE);

ret = sg_alloc_table(sgt, *sg_ents, GFP_KERNEL);

...

for_each_sgtable_sg(sgt, sg, i) {

pg = vmalloc_to_page(data);

...

s = min_t(int, PAGE_SIZE, size);

sg_set_page(sg, pg, s, 0);

size -= s;

data += s;

}

...

}這裡 Linux 先根據 size 算出總共需要幾個 scatter-gather 項目,接著逐頁呼叫 vmalloc_to_page(data) 找出目前這一段 vmalloc 位址對應到哪個 page,再用 sg_set_page() 把 (page, length) 寫進 sg_table。 因此,雖然邏輯上 vbuf->data_buf 仍然只是一整段 virtio_gpu_mem_entry[],但到了 virtqueue 這一層,它可能已經被拆成了多個 scatter-gather 項目

也正因如此,後面的 virtio_gpu_queue_fenced_ctrl_buffer() 才會在 vmalloc 分支裡把 elemcnt 加上 sg_ents,並把 sgs[outcnt] 指向 sgt->sgl。 換句話說,對 RESOURCE_ATTACH_BACKING 而言,virtio_gpu_mem_entry[] 在資料內容這一層仍然只是一段資料,但在實際送進 virtqueue 時,它有可能對應到多個 descriptor

至於 Linux 何時會出現這種情況,可以把 virtio_gpu_object_shmem_init()、kvmalloc_array()、virtio_gpu_queue_fenced_ctrl_buffer()、is_vmalloc_addr() 與 vmalloc_to_sgt() 這幾個函式串起來看:

- Linux 在

virtio_gpu_object_shmem_init()裡用kvmalloc_array()配置ents kvmalloc_array()會先嘗試kmalloc,只有當ents太大、無法維持這種配置方式時,才會退回 vmalloc- 到了

virtio_gpu_queue_fenced_ctrl_buffer(),只要is_vmalloc_addr(vbuf->data_buf)發現vbuf->data_buf已經落在 vmalloc 區,驅動就會改走vmalloc_to_sgt(),把原本整段virtio_gpu_mem_entry[]轉成sg_table - 因此對

RESOURCE_ATTACH_BACKING而言,virtio_gpu_mem_entry[]在資料內容這一層仍然只是一段資料,但在實際送進 virtqueue 時,承載它的 descriptor 可能不只一個

但目前 semu 假設了它走的是用 2 個 descriptor 的路徑,因此如果 guest 把 virtio_gpu_mem_entry[] 再拆成更多 data descriptor,這個 handler 就不會把整條鏈完整收進來

更進一步地說,目前 virtio-gpu 在處理 descriptor 時,最多只會操作 descriptor 鏈內的前 3 個節點,例如處理 QueueNotify 的 virtio_gpu_desc_handler():

static int virtio_gpu_desc_handler(virtio_gpu_state_t *vgpu,

const virtio_gpu_queue_t *queue,

uint32_t desc_idx,

uint32_t *plen)

{

/* virtio-gpu uses 3 virtqueue descriptors at most */

struct virtq_desc vq_desc[3] = {0};

/* Collect descriptors */

for (int i = 0; i < 3; i++) {

...

vq_desc[i].addr = desc[0];

vq_desc[i].len = desc[2];

vq_desc[i].flags = desc[3];

desc_idx = desc[3] >> 16;

if (!(vq_desc[i].flags & VIRTIO_DESC_F_NEXT))

break;

}

...

}或是 virtio-gpu 的各處在呼叫 virtio_gpu_find_response_desc() 時:

/* Find the response descriptor index (first descriptor with WRITE flag).

* Returns -1 if no writable descriptor is found.

*/

int virtio_gpu_find_response_desc(struct virtq_desc *vq_desc, int max_desc)

{

for (int i = 0; i < max_desc; i++) {

if (vq_desc[i].flags & VIRTIO_DESC_F_WRITE)

return i;

}

return -1;

}max_desc 的部分都是傳 3 進去,例如 virtio_gpu_get_display_info_handler():

void virtio_gpu_get_display_info_handler(virtio_gpu_state_t *vgpu,

struct virtq_desc *vq_desc,

uint32_t *plen)

{

int resp_idx = virtio_gpu_find_response_desc(vq_desc, 3);

...

struct vgpu_resp_disp_info *response = vgpu_mem_guest_to_host(

vgpu, vq_desc[resp_idx].addr, sizeof(struct vgpu_resp_disp_info));

...

memset(response, 0, sizeof(*response));

response->hdr.type = VIRTIO_GPU_RESP_OK_DISPLAY_INFO;

int scanout_num = vgpu_configs.num_scanouts;

for (int i = 0; i < scanout_num; i++) {

response->pmodes[i].r.width = PRIV(vgpu)->scanouts[i].width;

response->pmodes[i].r.height = PRIV(vgpu)->scanouts[i].height;

response->pmodes[i].enabled = PRIV(vgpu)->scanouts[i].enabled;

}

*plen = sizeof(*response);

}這裡的只操作前 3 個節點的決策也是基於 Linux kernel 的假設:

- 在

virtio_gpu_queue_fenced_ctrl_buffer()中,驅動先把 control buffer 拆成vcmd、vout、vresp三組 scatter-gather list,並用sgs[3]來承接這三個位置,因此目前才會基於「request header、一段資料段、一段回應段」的假設 - 但在

virtio_gpu_object_shmem_init()內用kvmalloc_array()配好的ents退回到 vmalloc 的情況下,virtio_gpu_queue_fenced_ctrl_buffer()會透過is_vmalloc_addr()改走vmalloc_to_sgt(),把原本那一組vout再展開成多個 scatter-gather 項目,一旦展開之後,實際 descriptor 數量就可能超過 semu 目前的假設

把 descriptor layout 釐清之後,virtio_gpu_cmd_resource_attach_backing_handler() 內的轉換就可以直接拆成四步來看:

- guest 先在

RESOURCE_ATTACH_BACKING的 request 裡提供nr_entries,表示這個資源後面要接多少個 backing entry。 每個 entry 都是一組(addr, length),對 semu 而言,這些欄位代表著 guest RAM 裡的哪幾段記憶體要拿來當這個資源的像素來源 virtio_gpu_cmd_resource_attach_backing_handler()會先讓pages指向從 descriptor 裡讀出來的struct vgpu_mem_entry[]陣列。 這時候pages[i].addr仍然只是 guest address,還不是 host 可以直接解參考的指標- 接著 handler 依照

nr_entries配置res_2d->iovec,然後逐項做轉換:對每個pages[i],呼叫vgpu_mem_guest_to_host(vgpu, pages[i].addr, pages[i].length),把 guest address 轉成 host 端可存取的位址,再填進res_2d->iovec[i].iov_base。 原本的pages[i].length則直接放進res_2d->iovec[i].iov_len - 完成之後,

res_2d->iovec[]就成為了這個資源在 host 端的 scatter-gather 視圖:page_cnt記住總共有幾段,iov_base指向每一段 backing entry 對應的 host 位址,iov_len記住每一段的長度

因此這一步的功能,是先把 guest 提供的分散 backing 記憶體整理成 host 之後能反覆使用的一組 iovec[]。 到這一步為止,res_2d->image 仍然是 host 端自己的 staging buffer,真正把 guest 像素搬進 res_2d->image,要等到下一步 TRANSFER_TO_HOST_2D 透過 iov_to_buf() 按 byte offset 去讀這組 iovec[] 才會做

TRANSFER_TO_HOST_2D:把分散的 backing pages 集合成 host 影像

這一步是 2D path 資料搬移的重點,virtio_gpu_cmd_transfer_to_host_2d_handler() 會先驗證資源是否存在、是否已 attach backing、區域是否越界,然後根據目標的種類決定要走哪種 copy path:

static void virtio_gpu_cmd_transfer_to_host_2d_handler(

virtio_gpu_state_t *vgpu,

struct virtq_desc *vq_desc,

uint32_t *plen)

{

...

struct vgpu_resource_2d *res_2d = vgpu_get_resource_2d(req->resource_id);

if (!res_2d) {

...

}

if (!res_2d->iovec) {

...

}

if (req->r.x > res_2d->width || req->r.y > res_2d->height ||

req->r.width > res_2d->width || req->r.height > res_2d->height ||

req->r.x + req->r.width > res_2d->width ||

req->r.y + req->r.height > res_2d->height) {

...

}

if (req->r.width == CURSOR_WIDTH && req->r.height == CURSOR_HEIGHT)

virtio_gpu_cursor_image_copy(res_2d);

else

virtio_gpu_copy_image_from_pages(req, res_2d);

...

}這裡用了 window.h 裡的 CURSOR_WIDTH / CURSOR_HEIGHT 去猜測是否走鼠標的快速路徑:

#define CURSOR_WIDTH 64

#define CURSOR_HEIGHT 64這只是 heuristic 的做法,它能動是因為目前 Linux guest 端的鼠標資源恰好是 64x64,不是協定的一部分

而真正逐列 copy 的邏輯位於 virtio_gpu_copy_image_from_pages():

static void virtio_gpu_copy_image_from_pages(struct vgpu_trans_to_host_2d *req,

struct vgpu_resource_2d *res_2d)

{

uint32_t stride = res_2d->stride;

uint32_t bpp = res_2d->bits_per_pixel / 8;

uint32_t width =

(req->r.width < res_2d->width) ? req->r.width : res_2d->width;

uint32_t height =

(req->r.height < res_2d->height) ? req->r.height : res_2d->height;

for (uint32_t h = 0; h < height; h++) {

size_t src_offset = req->offset + (size_t) stride * h;

size_t dest_offset =

((size_t) req->r.y + h) * stride + (size_t) req->r.x * bpp;

void *dest = (void *) ((uintptr_t) res_2d->image + dest_offset);

size_t total = (size_t) width * bpp;

iov_to_buf(res_2d->iovec, res_2d->page_cnt, src_offset, dest, total);

}

}這段其實就是把 TRANSFER_TO_HOST_2D 指定的矩形區域,一列一列地從 backing memory 搬到 res_2d->image 中對應的位置。 裡面的幾個欄位可以分開看:

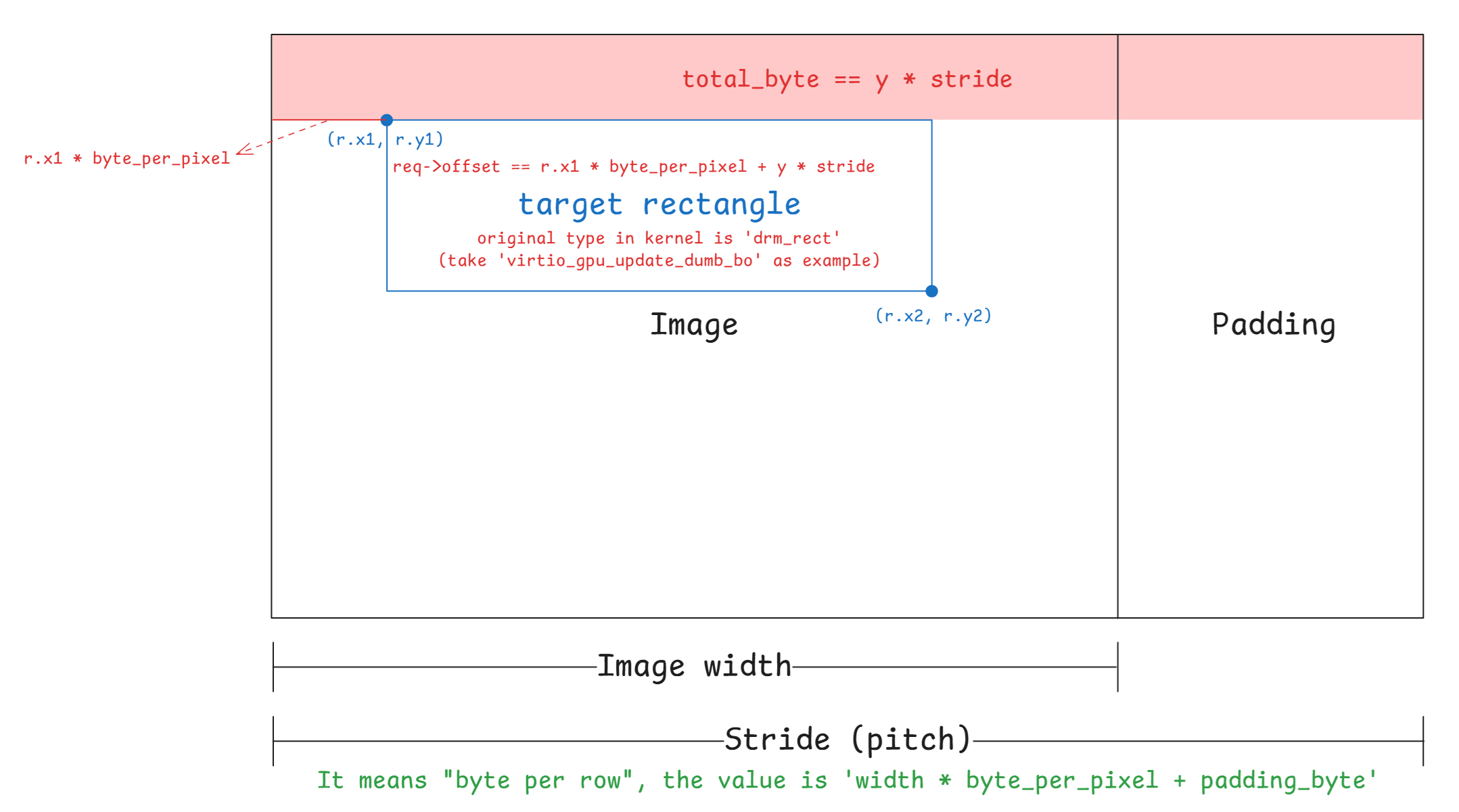

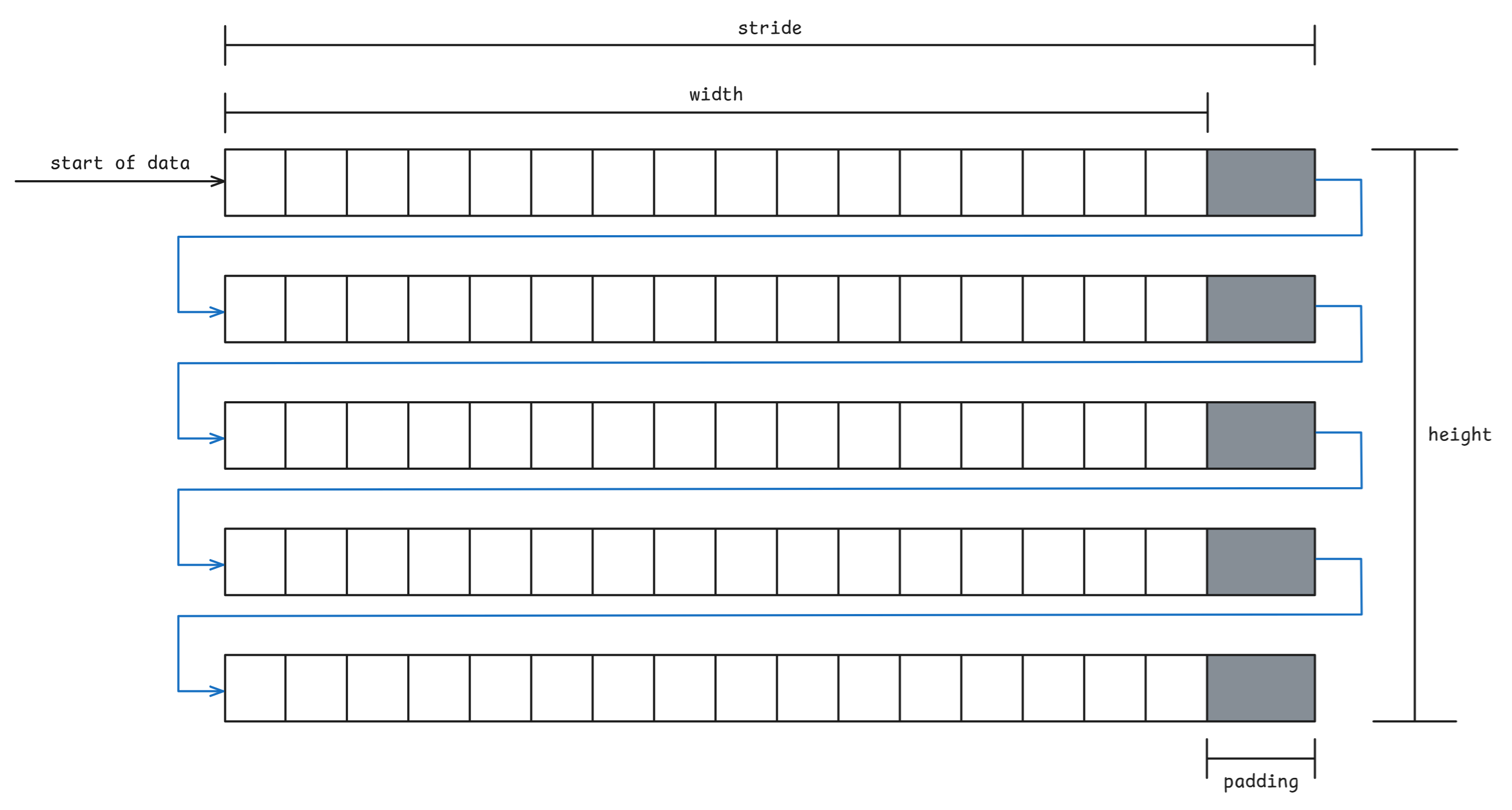

stride = res_2d->stride這裡的

stride是 host 端把這個 2D resource 視為線性影像時,每一列佔的位元組大小。 後面不管來源位移還是目的地位移,都以這個值作為「往下一列」要跳的距離要提一句的是,在 2D 的協定中並沒有傳遞 stride 的資訊,因此這邊的數值是 host 端在

virtio_gpu_resource_create_2d_handler內自己算的,同樣是基於 linux kernel 的實作所定的數值詳見下方的「問題 1」一節

bpp = res_2d->bits_per_pixel / 8TRANSFER_TO_HOST_2D的矩形資訊是用像素單位表示,但真正做memcpy時必須換成位元組。 這邊的bpp就代表每個像素佔多少 byte,例如ARGB8888會是4width和height這兩個值會先和

res_2d->width/res_2d->height做一次min(),以把本次傳輸的矩形限制在資源自己的尺寸內src_offset = req->offset + stride * h這是第

h列在來源 backing memory 視角下的距離起點的偏移量。req->offset是整個傳輸區塊的 base offset,而stride * h則會把它往下推到第h列dest_offset = ((req->r.y + h) * stride) + req->r.x * bpp這是第

h列在res_2d->image中的目標起點位移。 前半段((req->r.y + h) * stride)先定位到目的地第幾列,後半段req->r.x * bpp再定位到該列中第幾個像素開始寫。 這一輪實際做的事,是把來源端從src_offset開始的total個位元組,寫到目的地image + dest_offset對應的位置total = width * bpp每一輪迴圈只搬一整列裡真正需要的那一段,不會整個

stride全搬。 因此真正 copy 的長度是「這次矩形的寬度乘上每像素位元組數」,只覆蓋矩形內那一小段 scanline

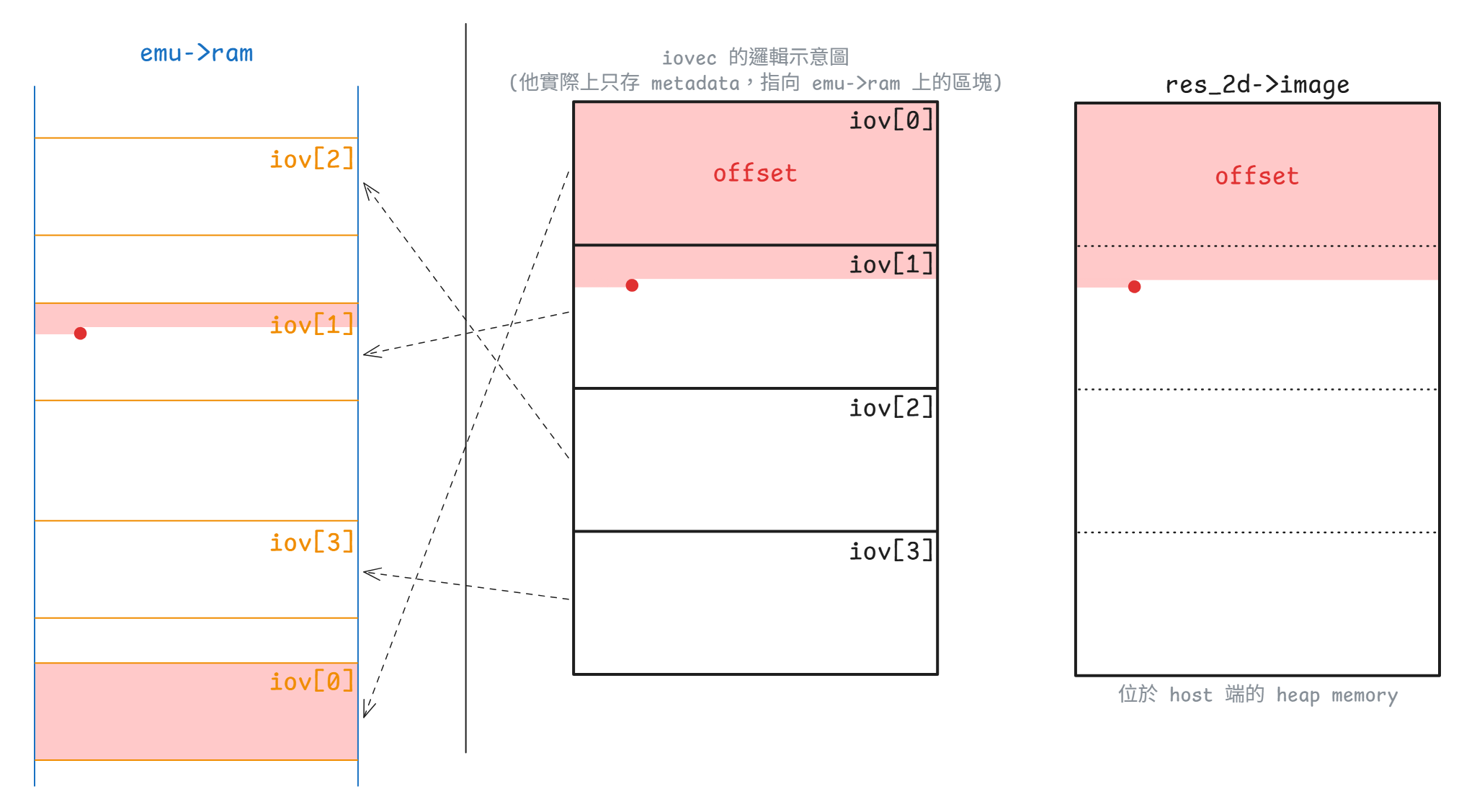

把 src_offset 和 dest_offset 這兩個位移一起看,整個函式的控制流就很清楚了:外層 for (h = 0; h < height; h++) 先逐列往下走,每一列先算出來源在 backing memory 中的 byte offset,再算出目的地在 res_2d->image 中的 byte offset,最後把「這一列需要的 width * bpp 位元組」交給 iov_to_buf()

因此 virtio_gpu_copy_image_from_pages() 負責決定矩形範圍與列位移,而真正跨越多段 iovec[] 去把資料拼回來的細節,才是 iov_to_buf() 的工作

iov_to_buf() 會把 res_2d->iovec[] 這組 host 端的 scatter-gather view 複製到 host 端連續的 res_2d->image。 因此後面的 SDL 後端並不需要自己理解 guest page layout,它只要看 vgpu_resource_2d.image 這塊連續緩衝區就夠了

這個 helper 本身也值得拆開看一下,它會帶著 offset 和 bytes 這兩個參數,沿著整組 scatter-gather view 直接往前走,並把需要的資料區間逐步複製到輸出 buffer:

size_t iov_to_buf(const struct iovec *iov,

const unsigned int iov_cnt,

size_t offset,

void *buf,

size_t bytes)

{

size_t done = 0;

for (unsigned int i = 0; i < iov_cnt; i++) {

if (iov[i].iov_base == NULL || iov[i].iov_len == 0)

continue;

if (offset < iov[i].iov_len) {

size_t remained = bytes - done;

size_t page_avail = iov[i].iov_len - offset;

size_t len = (remained < page_avail) ? remained : page_avail;